在碎片化閱讀充斥眼球的時代,越來越少的人會去關註每篇論文背後的探索和思考。

在這個欄目裡,你會快速 get 每篇精選論文的亮點和痛點,時刻緊跟 AI 前沿成果。

點選本文底部的「閱讀原文」即刻加入社群,檢視更多最新論文推薦。

@wangqy96 推薦

@wangqy96 推薦

#Knowledge Base

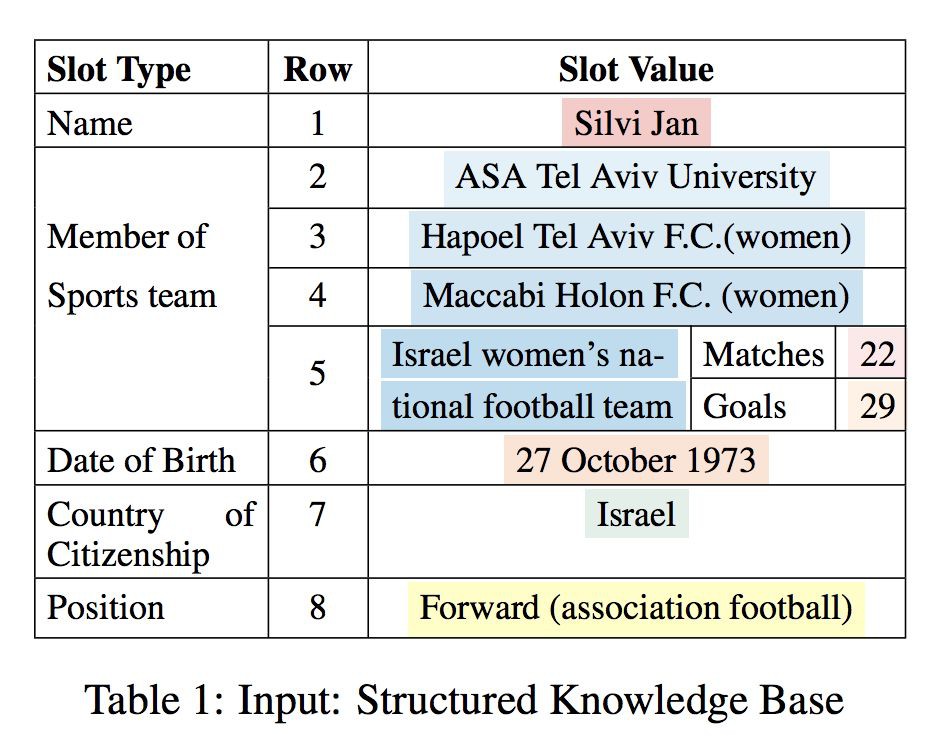

本文是倫斯勒理工大學發表於 INLG 2018 的工作,論文為結構化 KB 提供了有效的描述生成,並且提出基於 KB 重建的 metric 來評估在輸出中正確表達的事實數量。此外,論文還建立一個基於 Wikipedia 的 KB description dataset,包含 106,216 個物體。

▲ 論文模型:點選檢視大圖

@paperweekly 推薦

@paperweekly 推薦

#Document Relevance Ranking

本文是 Google AI 發表於 EMNLP 2018 的工作,主要研究的是深度學習在檢索中的應用。論文提出了三種針對檔案相關性排序的新模型,這幾種模型基於此前的 DRMM 模型(A Deep Relevance Matching Model for Ad-hoc Retrieval)。具體來說,DRMM 模型使用的是背景關係無關的 term encoding 編碼方式,而本文提出的改進模型則借鑒了 PACRR 的思想,融合了 n-grams 和不同方式編碼的背景關係資訊。

作者在 BioASQ 和 TREC Robust 2004 兩個資料集進行了實驗,實驗證明本文模型優於 BM25-baseline、DRMM 和 PACRR。

▲ 論文模型:點選檢視大圖

@paperweekly 推薦

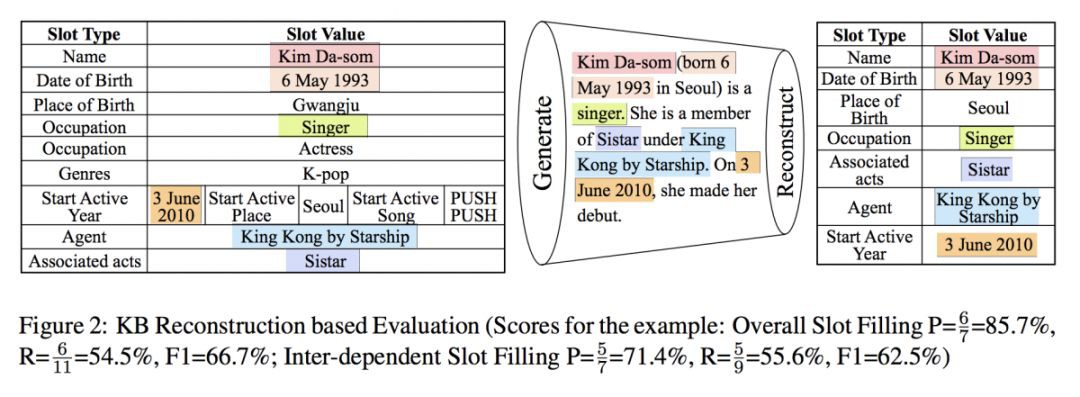

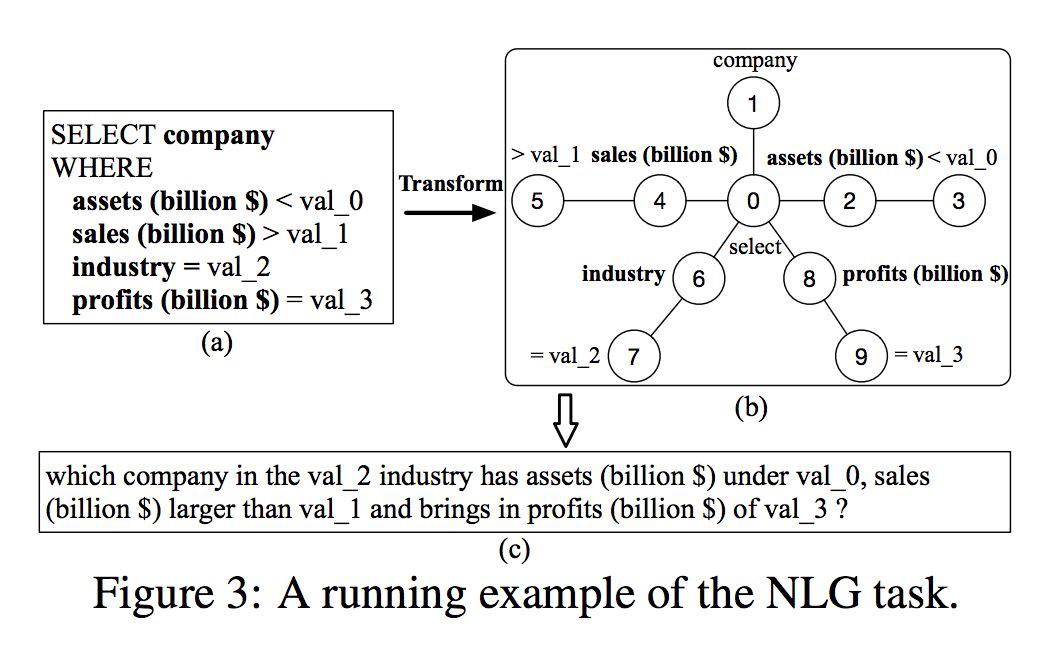

#Graph to Sequence Learning

本文是 IBM Research 發表於 ACL 2018 的工作,論文提出了一種將圖直接對映為序列的端到端模型——Graph2Seq。與 Seq2Seq 類似,該模型由一個 Graph 編碼器和一個 Sequence 解碼器組成。Graph 編碼器將輸入的圖對映為一個圖的表示以及一系列節點表示,而 Sequence 解碼器則基於這些表示生成相應的標的序列。

透過在 bAbI 任務、最短路徑任務以及自然語言生成任務上的實驗,本文證明瞭 Graph2Seq 模型可以被有效地用於從圖到序列的任務。

▲ 論文模型:點選檢視大圖

@paperweekly 推薦

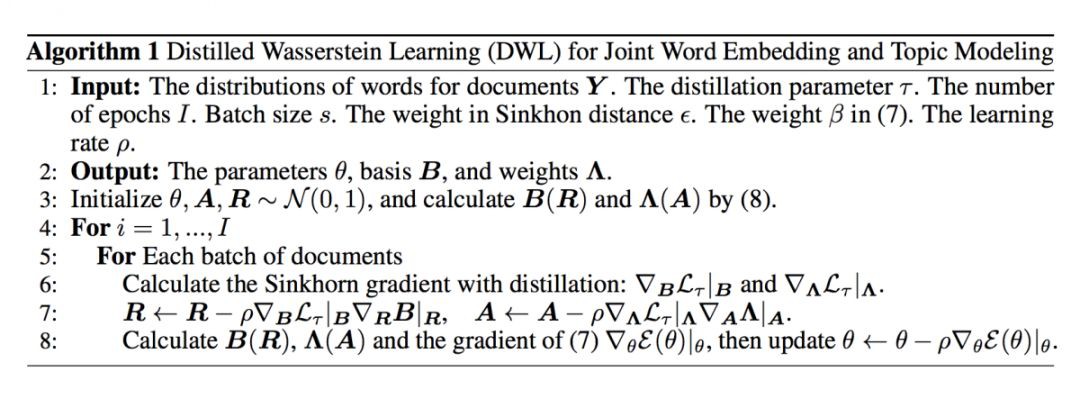

#Word Embeddings

本文是 Infinia ML Research、杜克大學和騰訊 AI Lab 發表於 NIPS 2018 的工作。論文基於 Wasserstein 距離和 Distillation 機制提出了一個全新思路,透過聯合訓練基於歐式距離的詞向量和基於 Wasserstein 距離的主題模型,大幅提升了詞向量的語意準確度。

▲ 論文模型:點選檢視大圖

@paperweekly 推薦

@paperweekly 推薦

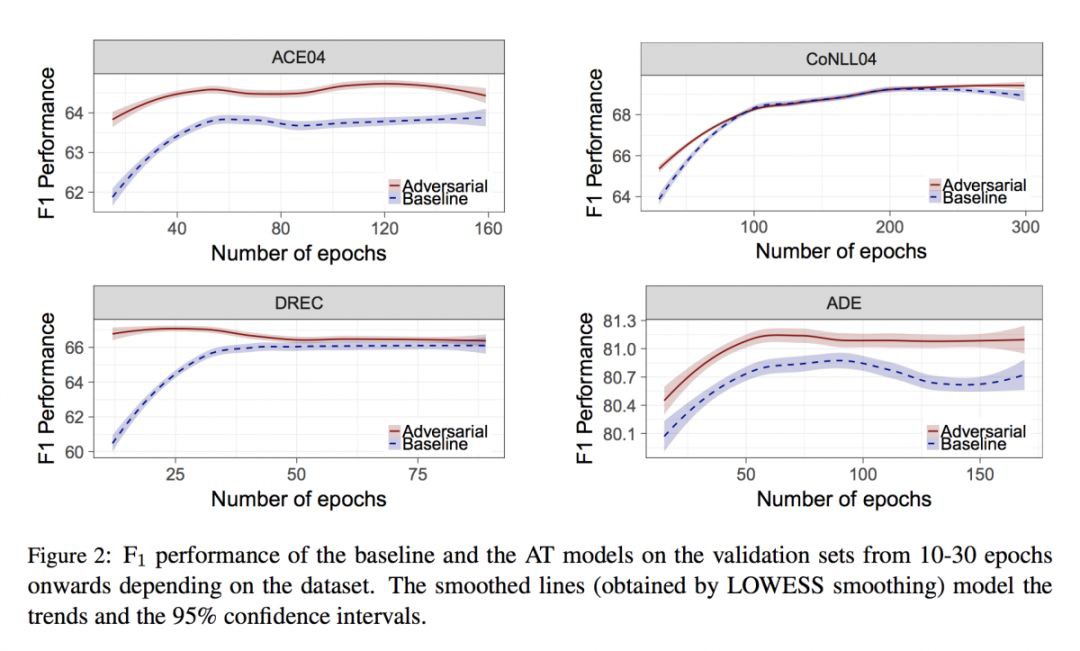

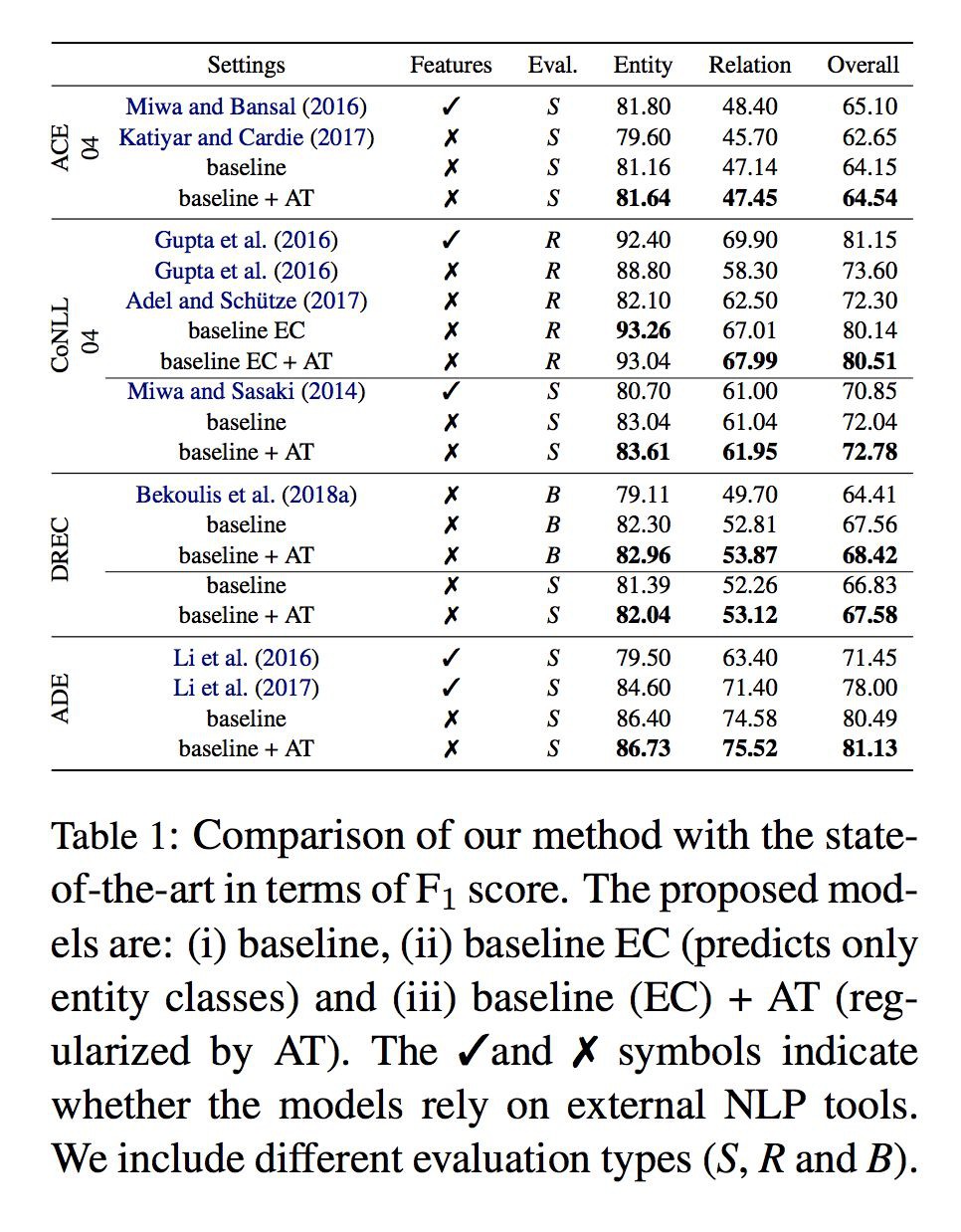

#Relation Extraction

本文是根特大學發表於 EMNLP 2018 的工作,論文提出了一個能同時執行物體識別和關係抽取任務的 multi-head selection 聯合模型。實驗證明本文模型在大多數資料集上,可以在不依賴其他 NLP 工具、且不使用人工設定特徵的情況下,同步解決多關係問題。

▲ 論文模型:點選檢視大圖

@hsu 推薦

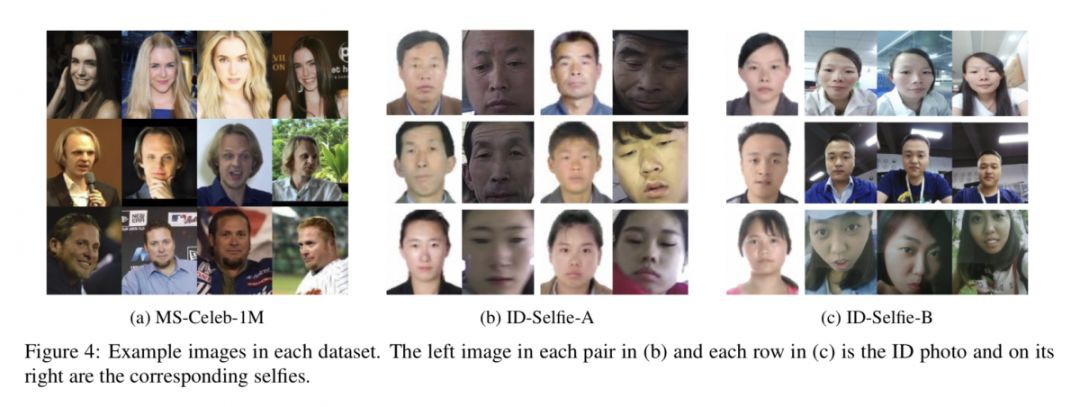

#Semantic Segmentation

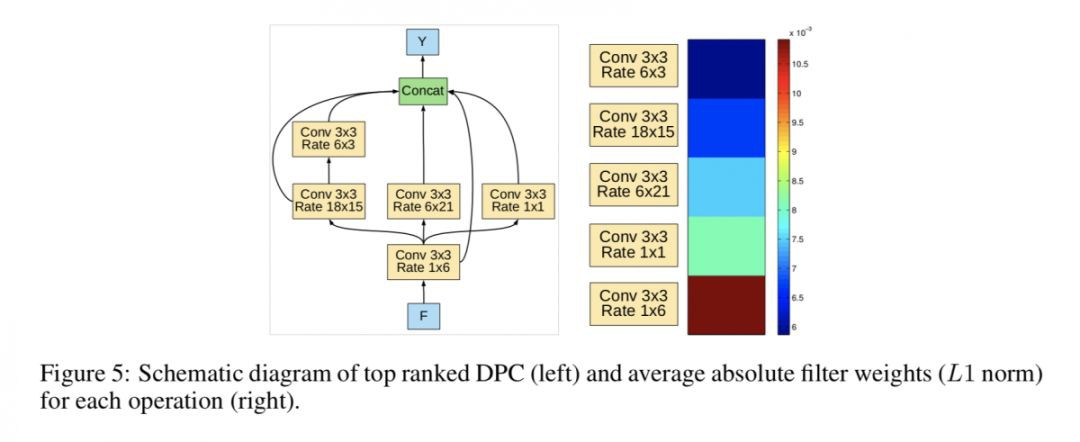

本文是 Google 發表於 NIPS 2018 的工作,論文首次提出了一個基於元學習的語意分割模型,可避免調參時過於玄學、沒有規律性的特點,受NAS啟發設計基於搜尋空間的語意分割網路模型。

此外,論文還提出了基於 Dense Prediction Cell (DPC) 構建的遞迴搜尋空間,對多尺度背景關係資訊編碼,實現語意分割任務。作者採用基於隨機搜尋的搜尋策略來找到最優的網路結構引數配置。

▲ 論文模型:點選檢視大圖

@Kralkatorrik 推薦

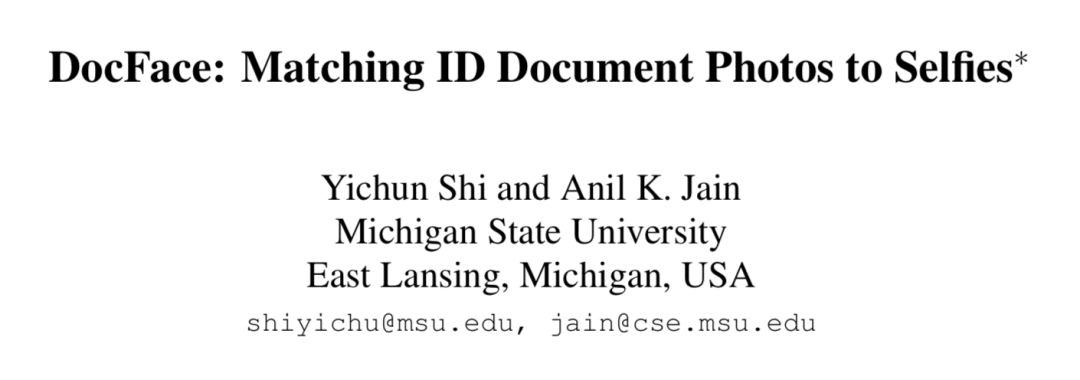

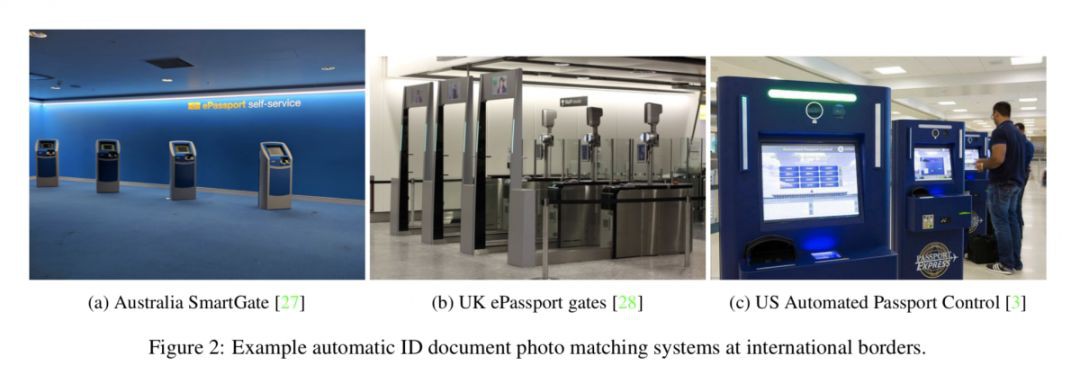

#Face Recognition

人證比對是人臉識別的一個重要應用場景,在主流的人臉識別研究中,通常是研究如何獲取更好的人臉表徵。本文提出了一種叫做 DocFace 的方法,透過遷移學習,將處於不同 domain 的證件照和生活照樣本對映到同一個 domain 中。

具體流程如下:

1. 使用 AM-Softmax 在清洗過的 MS-Celeb-1M 資料集上訓練一個基礎網路 F;

2. 從這個網路開始同時訓練兩個網路 (G,H) 來適應證件照和生活照,這個過程使用作者提出的 MPS loss 損失函式。

最終模型在私有 ID-Selfie 資料集上相比 basenetwork 能獲得 30% 以上的提升(FAR@0.001)。

▲ 論文模型:點選檢視大圖

@zmaker 推薦

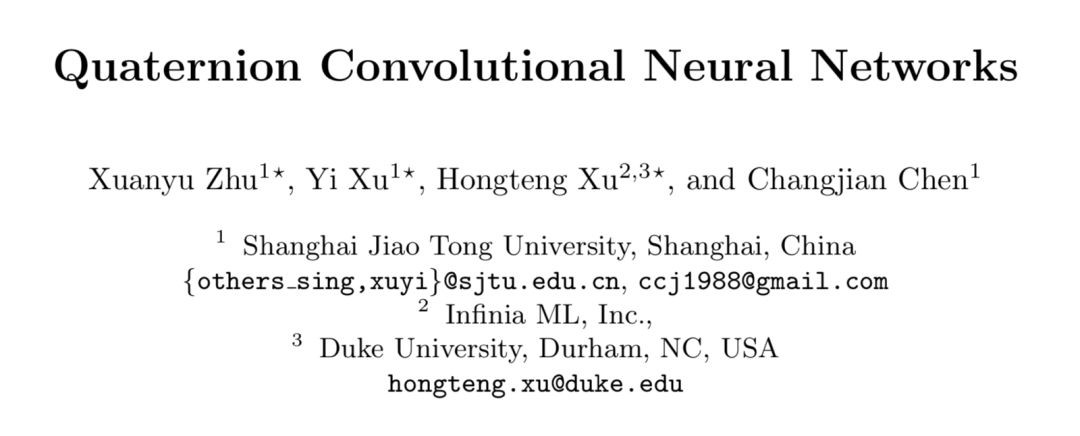

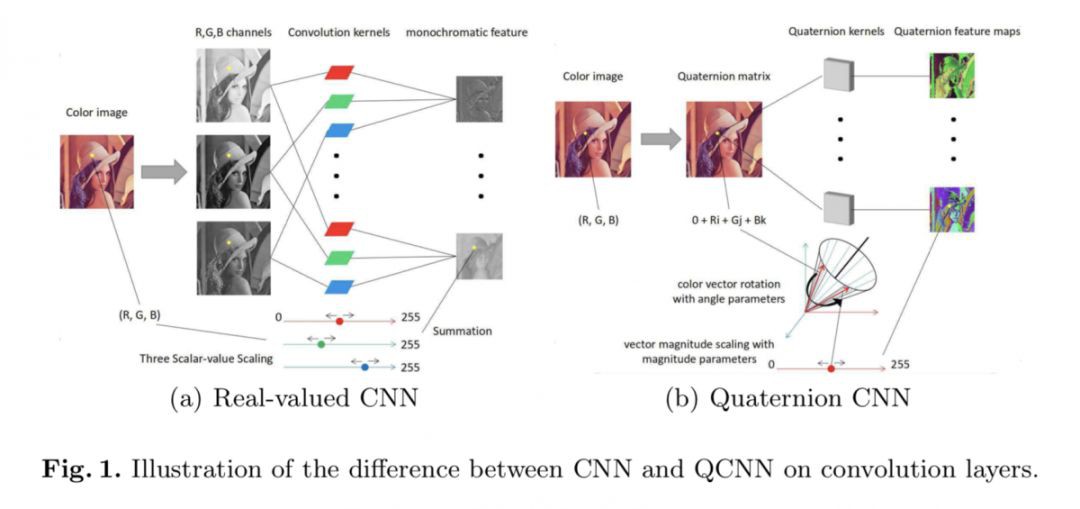

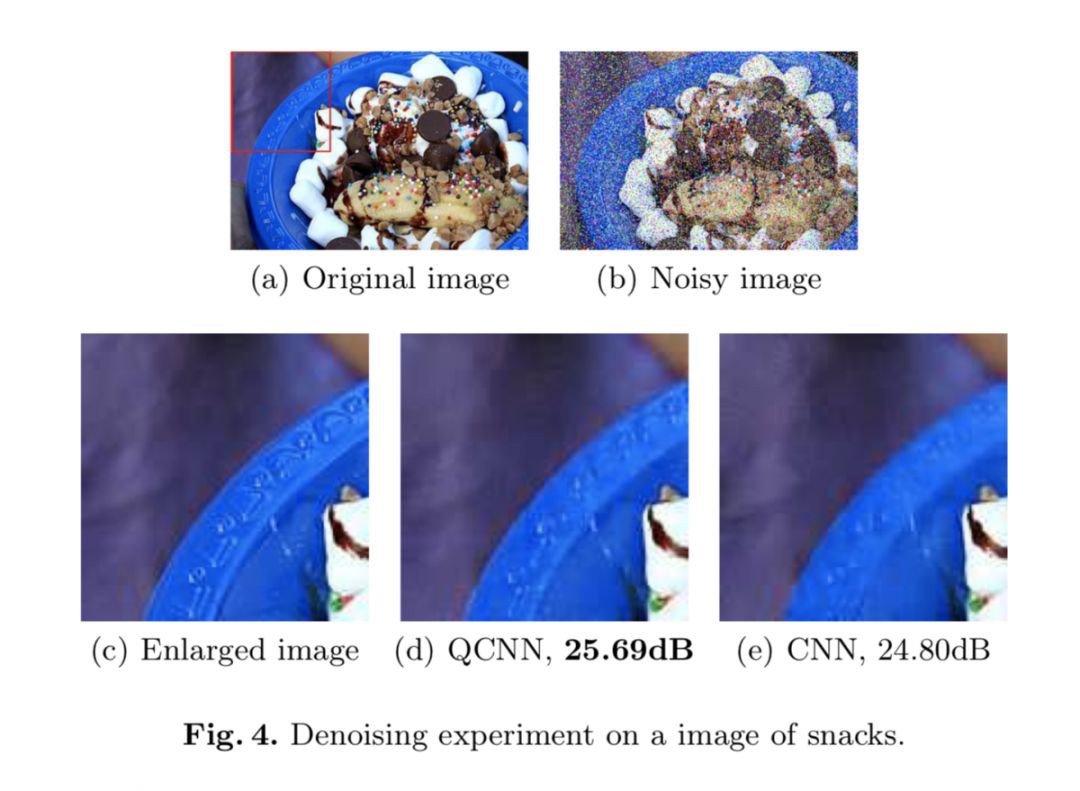

#Convolutional Neural Network

本文是上海交大和杜克大學發表於 ECCV 2018 的工作,論文提出了一種基於 Quaternion 的 CNN——QCNN。QCNN 將影象的 RGB 通道轉換到 Quaternion 數域進行討論,並由此給出了 quaternion convolution layers 和 quaternion fully-connected layers 等結構。文章從”微觀”上進行改進,提出了新的摺積神經網路,在 high-level vision task 和 low-level vision task 都取得了不錯的效果。

▲ 論文模型:點選檢視大圖

@Kralkatorrik 推薦

#Face Recognition

本文是商湯科技、UCSD 和南洋理工大學發表於 ECCV 2018 的工作。論文對於現有人臉資料集中的標簽噪聲問題進行了深入研究,對 MegaFace 和 MS-Celeb-1M 資料集中的噪聲特性和來源做了全面的分析,發現乾凈子集對於提高人臉識別精度效果顯著。

▲ 論文模型:點選檢視大圖

@Fiersies 推薦

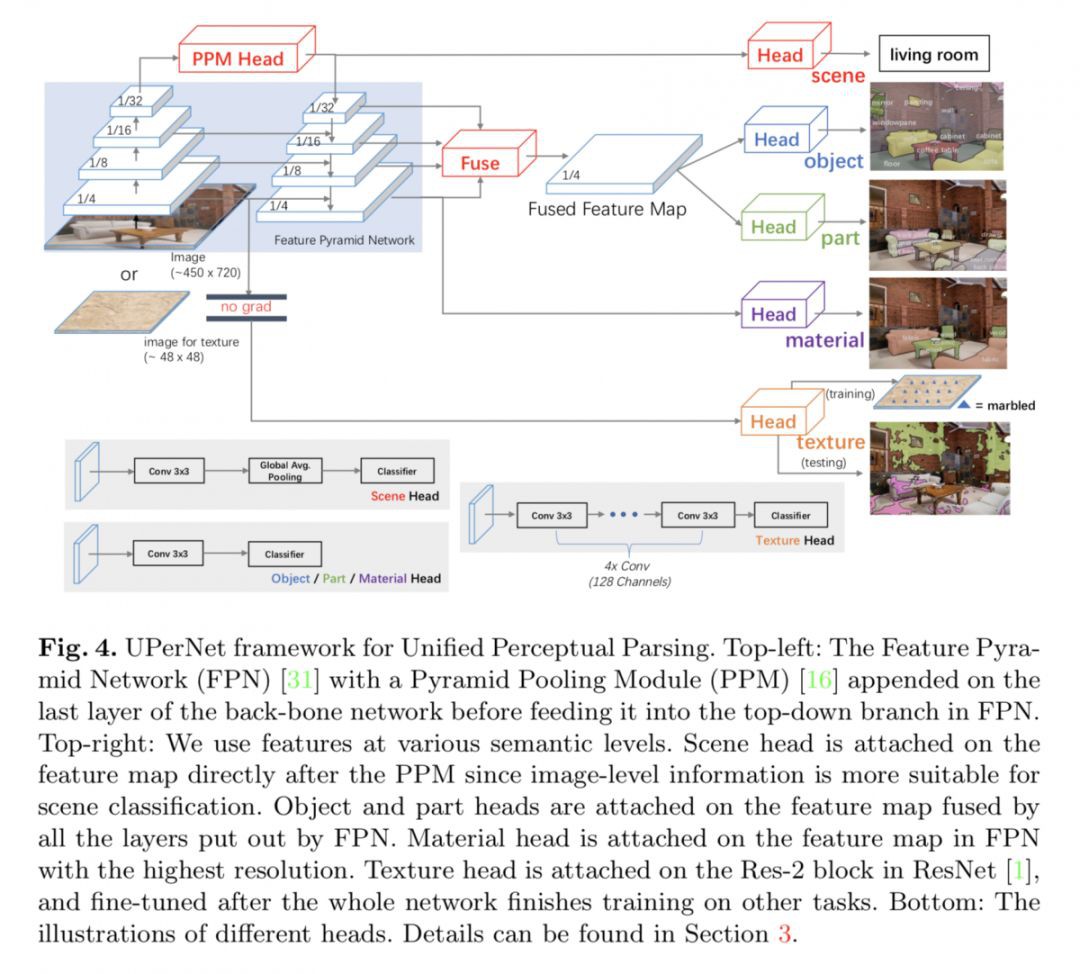

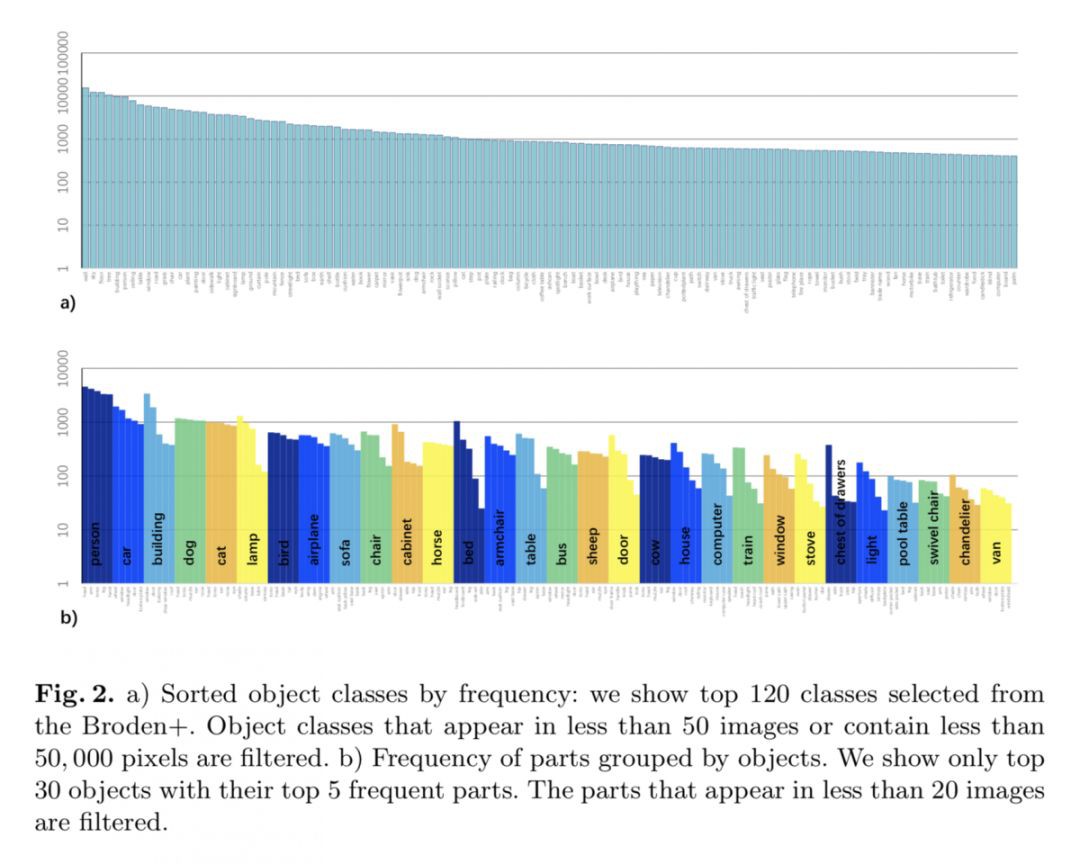

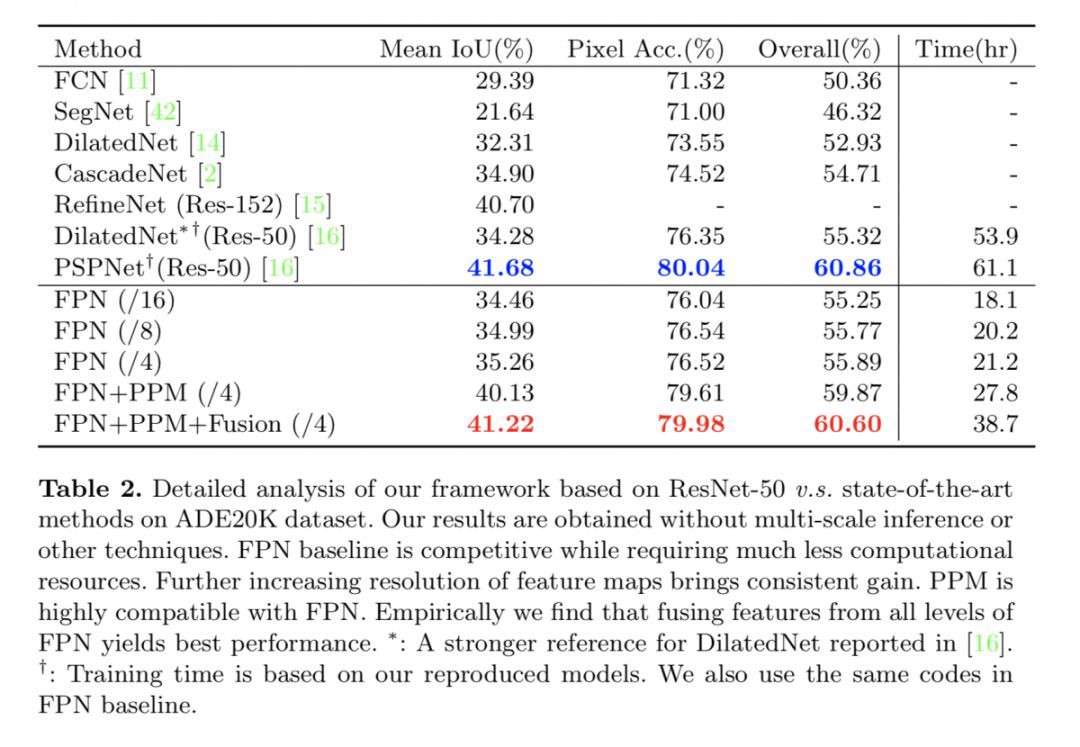

#Scene Understanding

本文是北京大學、MIT、位元組跳動和曠視科技發表於 ECCV 2018 的工作,論文提出了名為統一感知解析 UPP 的新任務,要求機器視覺系統從一張影象中識別出盡可能多的視覺概念;又提出多工框架 UPerNet ,開發訓練策略以學習混雜標註。UPP 基準測試結果表明,UPerNet 可有效分割大量的影象概念。

▲ 論文模型:點選檢視大圖

@xuzhou 推薦

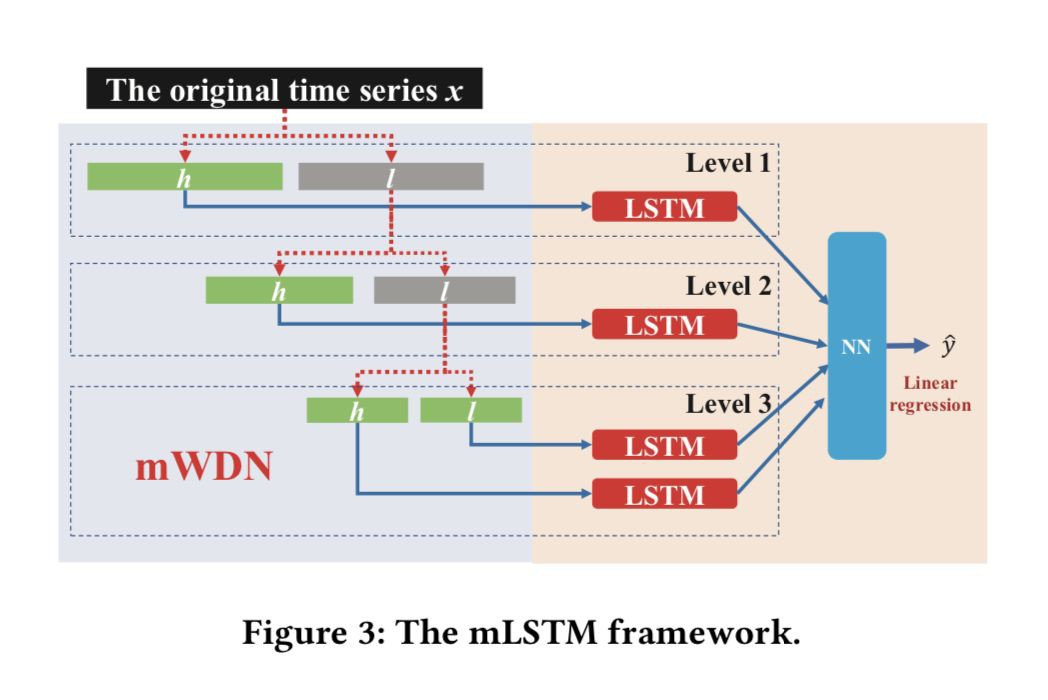

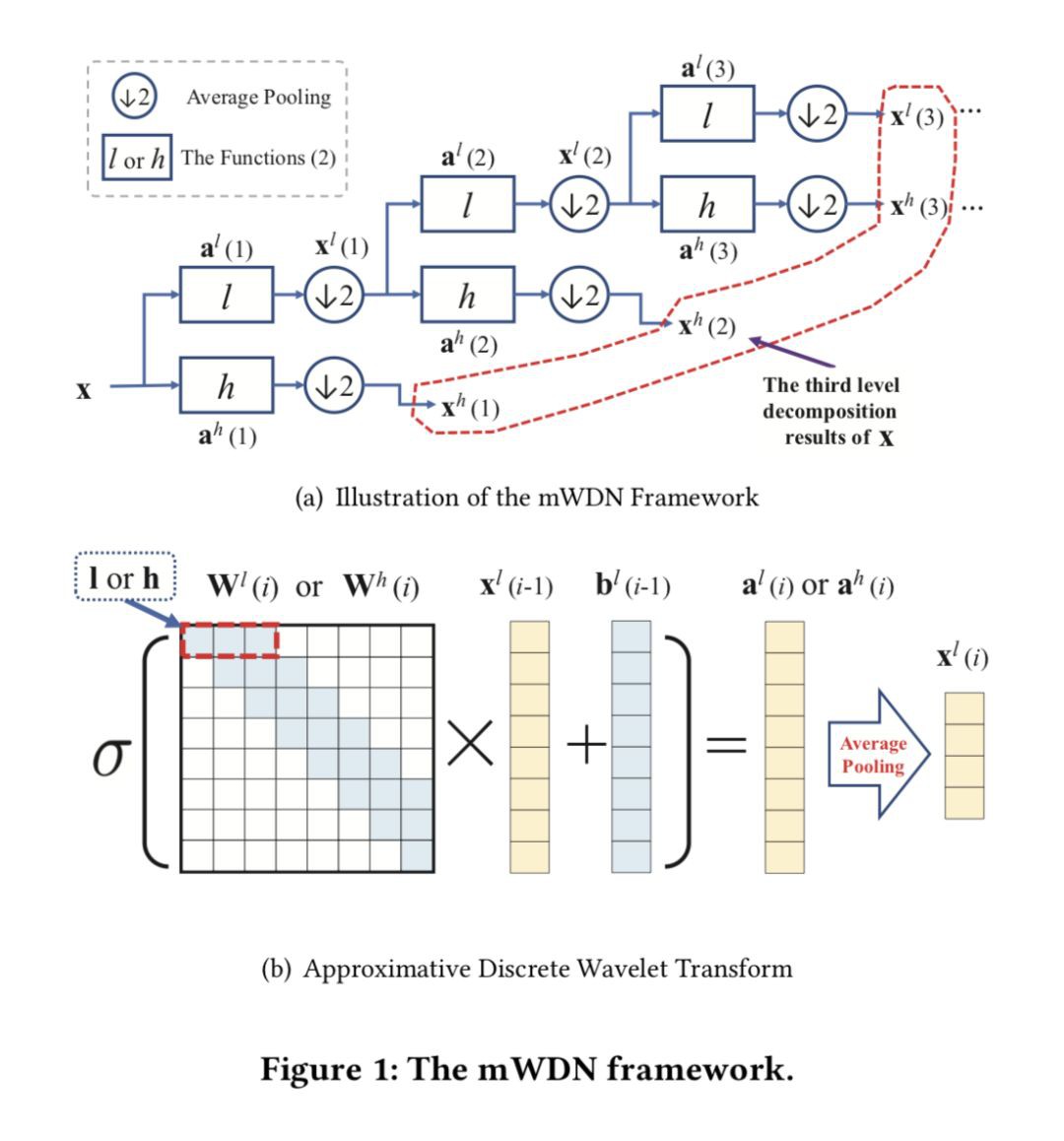

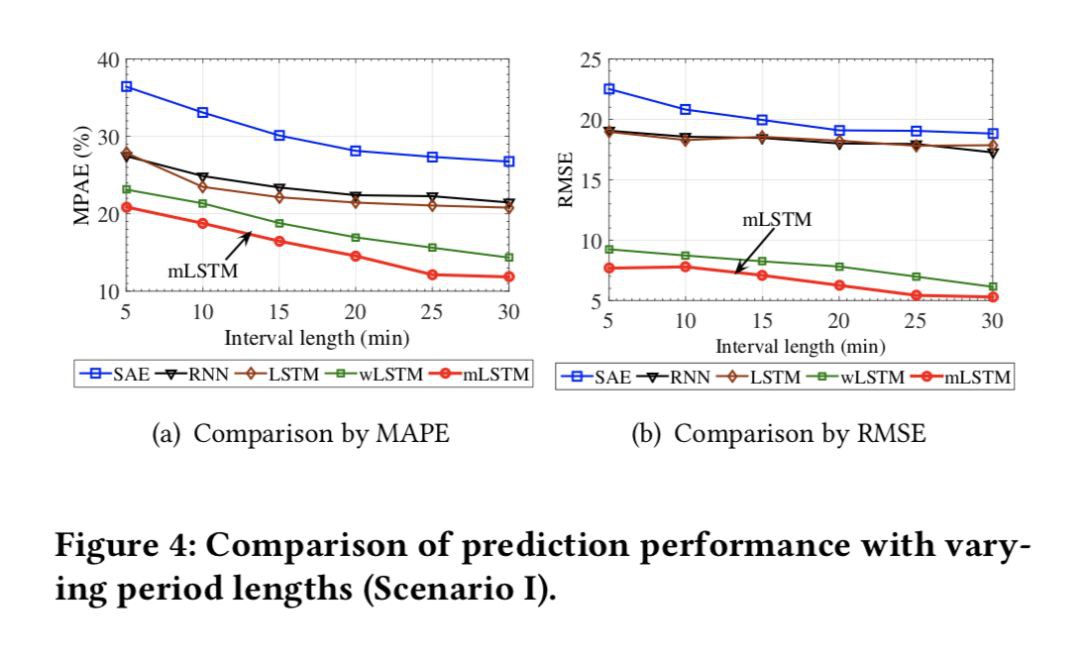

#Wavelet Transform

本文是北京航空航天大學發表於 KDD 2018 的文章,論文提出將小波變換和深度神經網路進行完美結合,剋服了融合的損失,對時間序列資料的分析起到了很好的啟發性研究。

▲ 論文模型:點選檢視大圖

@paperweekly 推薦

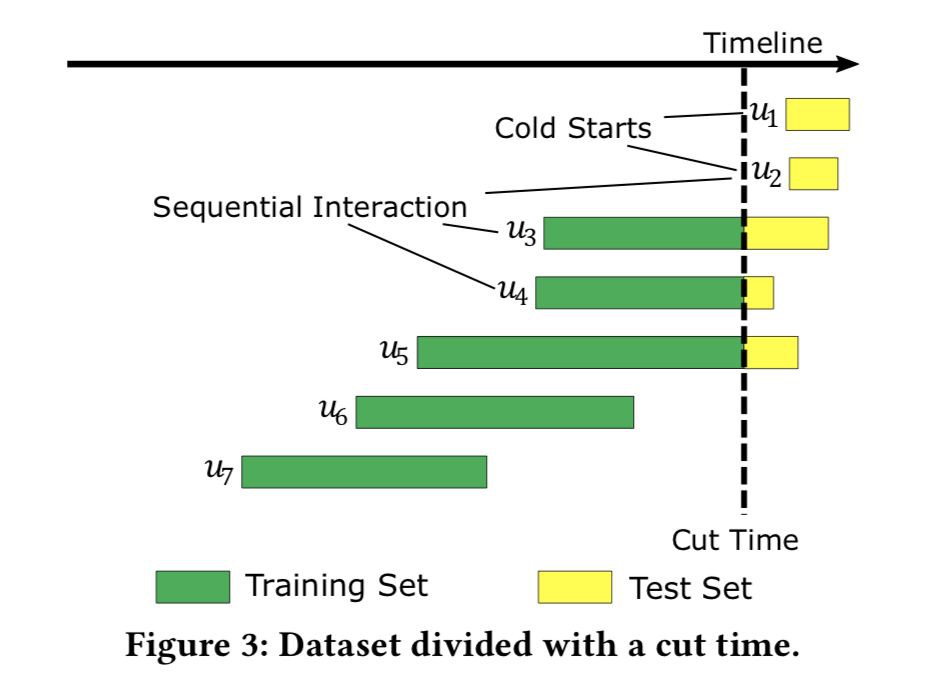

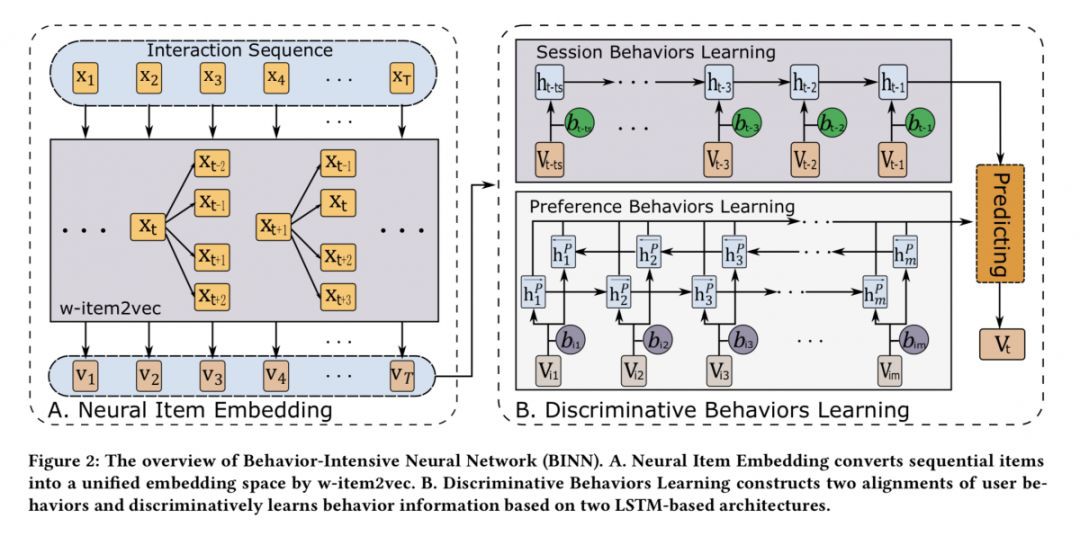

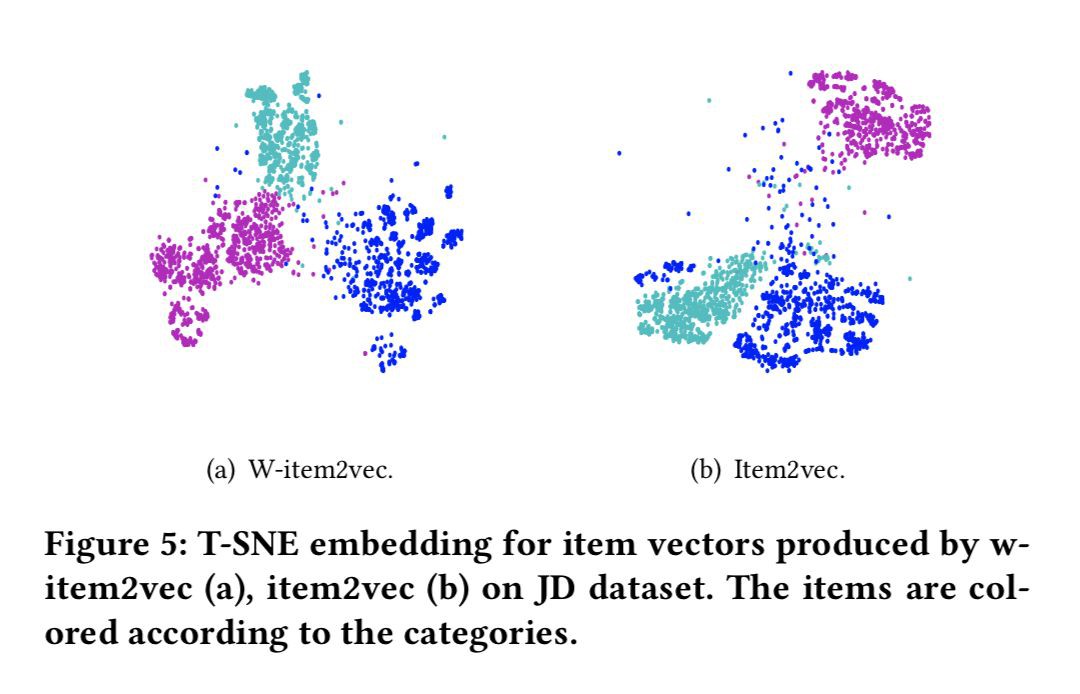

#Session-based Recommendation

本文是中科大和京東發表於 SIGKDD 2018 的工作。現有的序列化推薦方法往往僅對消費者的短期行為特徵進行分析,沒有充分考慮到使用者的長期偏好以及偏好的動態變化過程。本文基於使用者行為區別,提出了一個針對商品推薦任務的全新 BINN(Behavior-Intensive Neural Network)模型,該模型包括一個 Item Embedding 和兩個 RNN。Item Embedding 對使用者產生的 item 序列運用類 Skip-gram 的模型,兩個 RNN 分別用於捕獲使用者當前偏好和歷史偏好。

▲ 論文模型:點選檢視大圖

@zhangjun 推薦

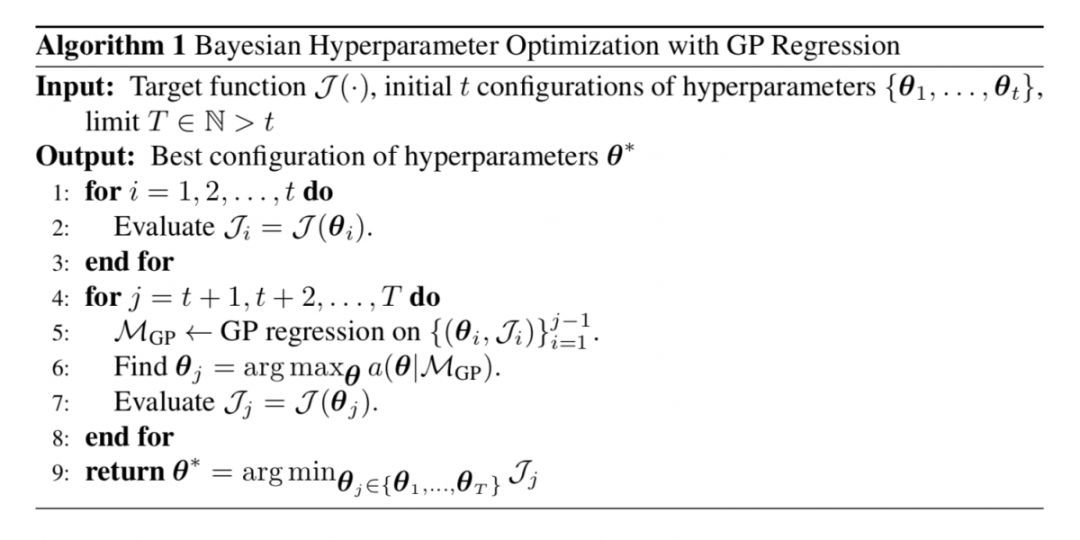

#Bayesian Optimization

本文來自 NIPS 2017 BayesOpt Workshop,論文提出了一種基於遷移學習的初值設定方法,用來提升貝葉斯最佳化搜尋最優超引數的效率。文中透過學習一個基於 DNN 的距離函式,來找到最相似的 K 個 dataset,將這些 dataset 的最優超引數定為 target 任務的幾個初值,開始迭代尋優。

實驗結果表明,高質量的初值將會讓最佳化收斂更快。但用一個非常複雜的深度學習網路來計算相似度有一點殺雞焉用牛刀的感覺,深度學習網路會帶來更多的超引數,形成了死迴圈。

▲ 論文模型:點選檢視大圖

@zhangjun 推薦

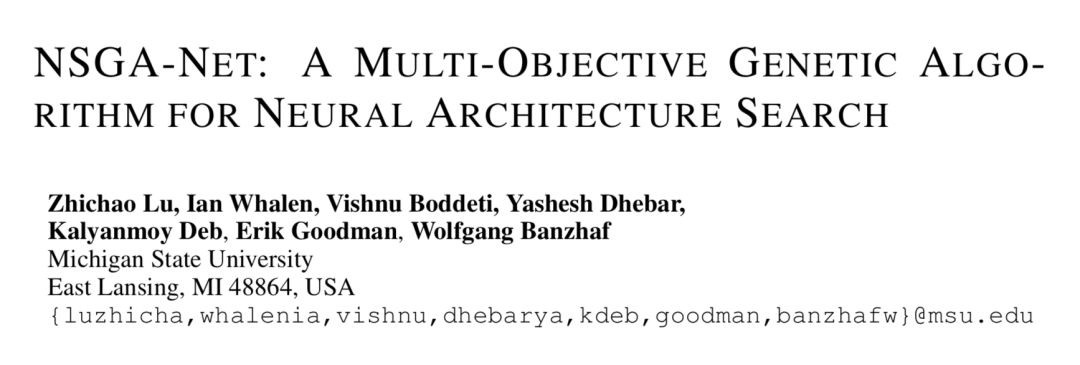

#Neural Architecture Search

本文來自密西根州立大學,論文提出了一種多標的神經網路架構搜尋框架 NSGA-Net,整個演演算法框架基於進化演演算法思路,透過 crossover 和 mutation 進行 exploration,然後基於已有的知識,學習一個基於貝葉斯最佳化模型(BOA),用於 exploitation。此處的 BOA 和自動調參中常見的貝葉斯最佳化不同,而是一種 EDA 演演算法,用貝葉斯網路作為機率模型。

▲ 論文模型:點選檢視大圖

@paperweekly 推薦

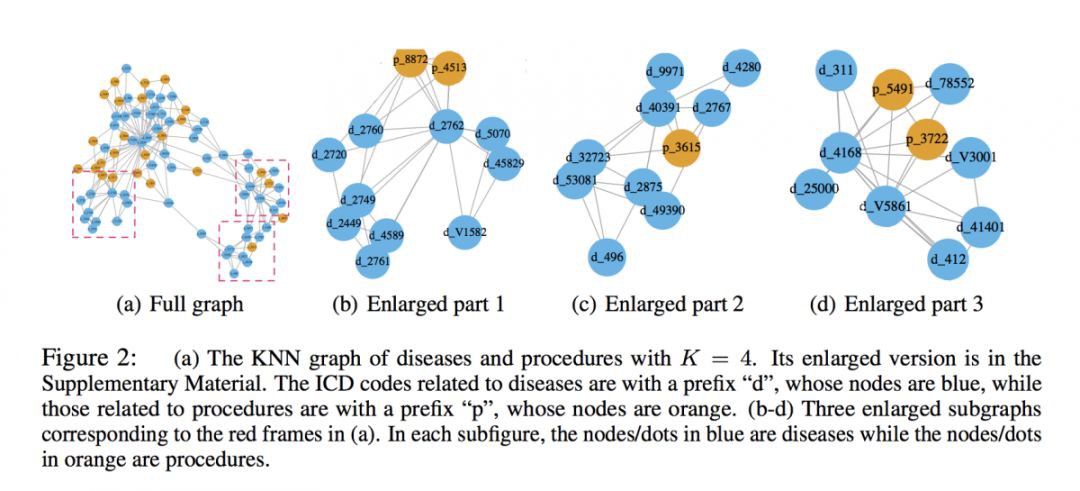

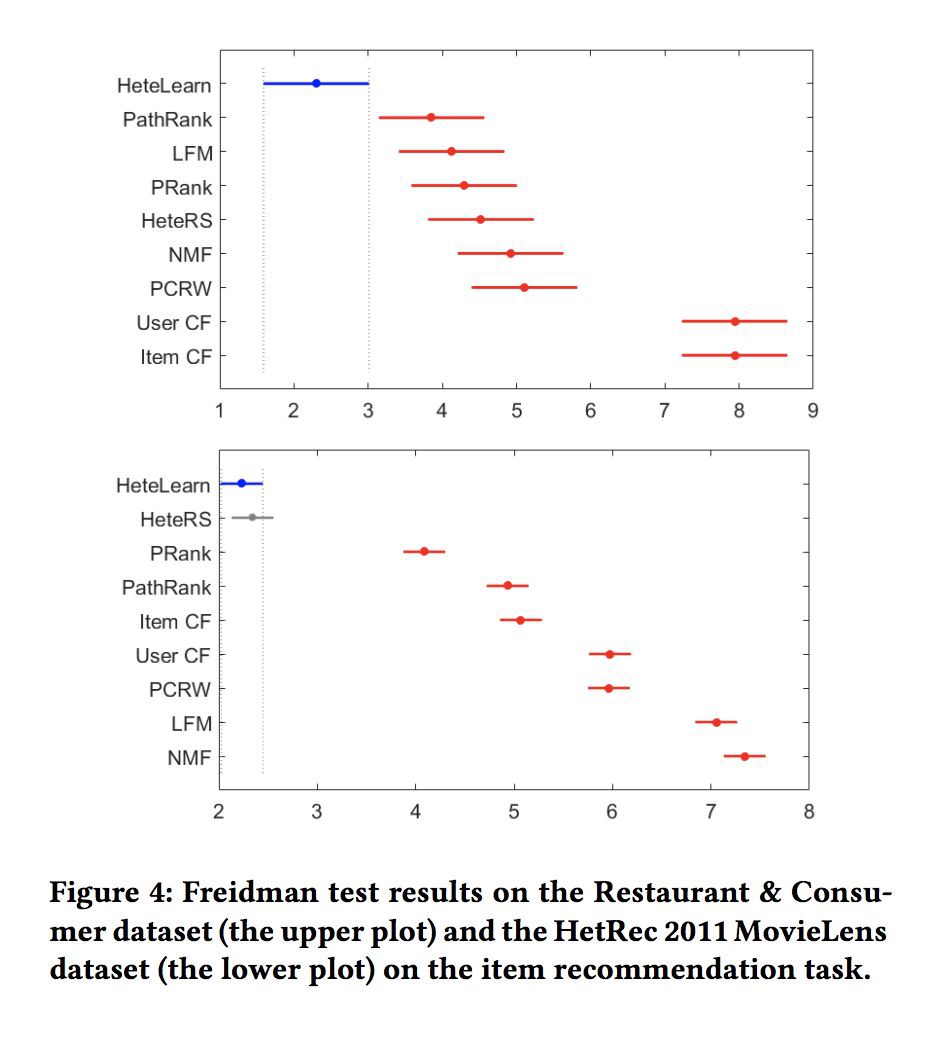

#Recommender System

本文是北京大學發表於 WSDM 2018 的工作。基於異構資訊網路(HIN)的推薦由於其在模擬協同過濾、內容過濾、背景關係感知推薦等方面的能力而受到廣泛關註。現有各類方法的關鍵在於如何正確設定異構資訊網路中各種 link 的權重。

本文提出了一種基於貝葉斯個性化排序(BPR)的機器學習方法——HeteLearn,來學習異構資訊網路中的 link 權重,並將其應用於個性化推薦任務。作者在個性化推薦和標簽推薦任務上對本文方法進行了測試,實驗表明,本文方法表現明顯優於傳統的協同過濾推薦演演算法和當前最先進的基於 HIN 的推薦方法。

▲ 論文模型:點選檢視大圖

@deanli 推薦

#Graph Convolution Neural Network

本文是斯坦福大學發表於 KDD 2018 的工作。論文提出了一種圖摺積網路層次化的池化方法,“圖摺積網路+池化”可以將 graph 表示成低維向量,從而簡化 graph 之間的計算。本文方法與現有 Graph Pooling 方法不同的是,作者將 graph 中 vertex 的層次關係考慮了進去。

如何獲取 vertex 的層次關係以及如何將 l 層的 n 個 vertex 對映到 l+1 層的 m 個 vertex 是研究的重點之一。本文透過 GCN 學習得到 assign matrix S ∈ R^(n*m),assign matrix 中元素代表 l 層中 vertex 與 l+1 層中 m 個 vertex 的關聯強度。透過 S 對 l 層的 adjacency matrix 和vertex matrix 做變換得到 l+1 層的兩個矩陣,作為 GCN 的輸入。

▲ 論文模型:點選檢視大圖

#推 薦 有 禮#

#推 薦 有 禮#

本期所有入選論文的推薦人

均將獲得PaperWeekly紀念周邊一份

▲ 深度學習主題行李牌/卡套 + 防水貼紙

禮物領取方式

推薦人請根據論文詳情頁底部留言

新增小助手領取禮物

想要贏取以上週邊好禮?

點選閱讀原文即刻推薦論文吧!

點選以下標題檢視往期推薦:

#投 稿 通 道#

#投 稿 通 道#

讓你的論文被更多人看到

如何才能讓更多的優質內容以更短路徑到達讀者群體,縮短讀者尋找優質內容的成本呢? 答案就是:你不認識的人。

總有一些你不認識的人,知道你想知道的東西。PaperWeekly 或許可以成為一座橋梁,促使不同背景、不同方向的學者和學術靈感相互碰撞,迸發出更多的可能性。

PaperWeekly 鼓勵高校實驗室或個人,在我們的平臺上分享各類優質內容,可以是最新論文解讀,也可以是學習心得或技術乾貨。我們的目的只有一個,讓知識真正流動起來。

? 來稿標準:

• 稿件確系個人原創作品,來稿需註明作者個人資訊(姓名+學校/工作單位+學歷/職位+研究方向)

• 如果文章並非首發,請在投稿時提醒並附上所有已釋出連結

• PaperWeekly 預設每篇文章都是首發,均會新增“原創”標誌

? 投稿郵箱:

• 投稿郵箱:hr@paperweekly.site

• 所有文章配圖,請單獨在附件中傳送

• 請留下即時聯絡方式(微信或手機),以便我們在編輯釋出時和作者溝通

?

現在,在「知乎」也能找到我們了

進入知乎首頁搜尋「PaperWeekly」

點選「關註」訂閱我們的專欄吧

關於PaperWeekly

PaperWeekly 是一個推薦、解讀、討論、報道人工智慧前沿論文成果的學術平臺。如果你研究或從事 AI 領域,歡迎在公眾號後臺點選「交流群」,小助手將把你帶入 PaperWeekly 的交流群裡。

▽ 點選 | 閱讀原文 | 獲取更多論文推薦

知識星球

知識星球