作為全球首個以培養 EQ 為標的的 AI 聊天機器人,微軟小冰於 2014 年誕生,當年 6 月在微博上線,因性格活潑、聊天能力強引起熱烈反響,在過去的幾年中,微軟小冰陸續入駐微信、京東電商、QQ、Windows 10 等平臺,先後解鎖了主持人、唱歌、寫詩創作等技能,成為無處不在的“二次元文藝少女”。

在微軟小冰第五代釋出的時候,沈向洋已經表示:“小冰是一個聊天機器人,但不僅僅是一個聊天機器人,聊天只是使用者的一個體驗,但微軟設計產品理念的真正核心在於打造一個情感計算框架。”2018 年 7 月 26 日,微軟小冰正式進入第六代,這也是微軟小冰歷史上最大規模的一次全面升級,升級內容涉及到微軟小冰情感計算框架的所有組成部分。小冰的產品形態涉及對話式人工智慧機器人、智慧語音助手、人工智慧創造內容提供者和一系列垂直領域解決方案,改寫全球五個國家的 40 餘個平臺。

從一個聊天機器人轉化成一個完整的情感計算框架,再從情感計算框架轉化成各種各樣的產品形態,與各種各樣垂直領域的方向進入到人類社會生活的方方面面去,這是第六代微軟小冰最為顯著的特點。

這位明明可以靠顏值卻非要靠才華的“水手服少女”背後,究竟隱藏著怎樣的秘密?不妨透過以下三篇來自微軟的最新論文,來看看小冰是如何透過寫詩創作、即興編曲來實現養家餬口的。

小冰樂隊

論文摘要

隨著音樂創作知識的發展和近年來需求的增加,越來越多的公司和研究機構開始研究音樂的自動生成。但以往的模型在應用於歌曲生成時存在侷限性,這既需要旋律,又需要編曲。此外,許多與歌曲質量有關的關鍵因素沒有得到很好的解決,例如和絃進行和節奏樣式。特別是。如何確保多音軌音樂的和諧,這仍然是一個有待探索的問題。

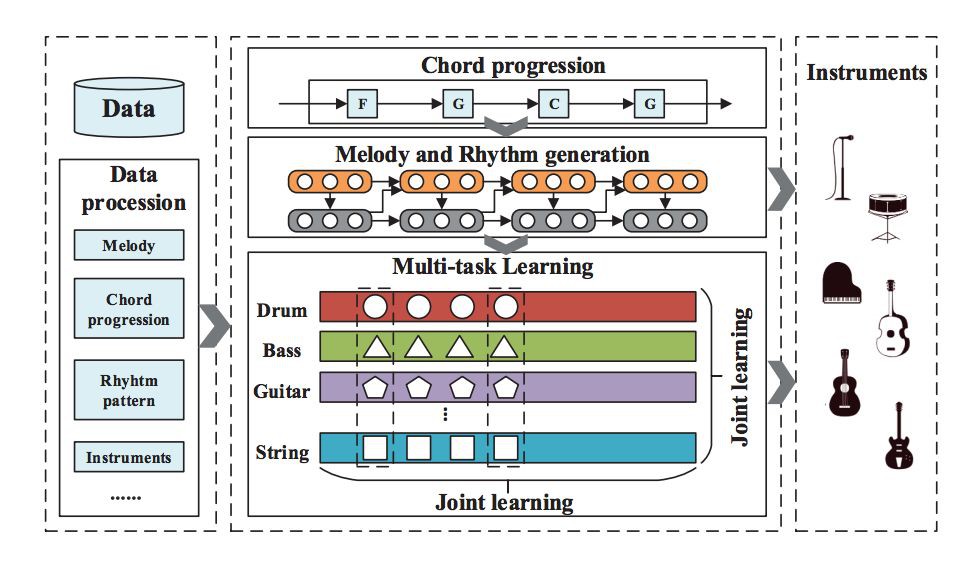

為此,我們對流行音樂的自動生成進行了重點研究,其中,我們考慮了旋律生成的和絃和節奏的影響,以及音樂編排的和聲。我們提出了一種端到端的旋律和編麴生成框架,稱為“小冰樂隊”(XiaoIce Band),該框架產生了由幾種樂器演奏的幾個伴奏曲目組成的旋律音軌。

具體來說,我們設計了一種基於和絃的節奏和旋律交叉生成模型(CRMCG),以生成帶有和絃進行的旋律。然後,我們提出一種基於多工學習的多樂器協同編曲模型( Multi-Instrument Co-Arrangement Model ,MICA)。最後,我們在一個真實資料集上進行了廣泛的實驗,結果證明瞭 XiaoIce Band 的有效性。

本文獲得 KDD 2018 Research Track 最佳學生論文。

論文貢獻

-

我們提出了一種端到端的多軌音樂生成系統,包括旋律和編曲。

-

基於音樂知識,我們提出用和絃進行來指導旋律和透過節奏型來學習歌曲的結構。然後,我們使用節奏和旋律交叉生成方法進行音樂生成。

-

我們在解碼器層的每一步使用其他任務狀態開發多工聯合生成網路,這提高了生成質量並確保了多軌音樂的和諧。

-

透過提供的大量實驗,我們的系統與其他模型表現更好的效能,人工評估也得到一致的結論。

論文模型 & 效果

▲ 圖1. 我們生成的歌曲示例

▲ 圖2. 標有“和絃進行”的歌曲“We Don’t Talk Anymore”的旋律

▲ 圖3. 流行歌曲的音軌和樂器分析

▲ 圖4. 小冰樂隊的流程圖概述

▲ 圖5. CRMCG

▲ 圖6. (a): MICA (b): 註意單元 (c): MLP單元

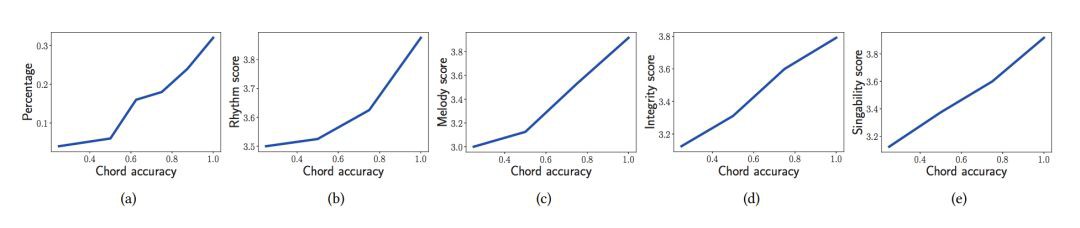

▲ 圖7. 與人類研究相比的和絃的分析

▲ 圖8. 節奏分佈

▲ 圖9. 四個部分的編曲分析

▲ 圖10. 編曲的和諧分析(G:吉他,S:弦樂,B:貝斯)

影象激發詩歌生成

論文摘要

詩歌的創作靈感一般來源於視覺。不同的解讀者對於物件和從影象中觀察到的情感印記會有各種各樣的感覺。我們在本論文中提出一個從影象生成詩歌的系統來模仿這一過程。

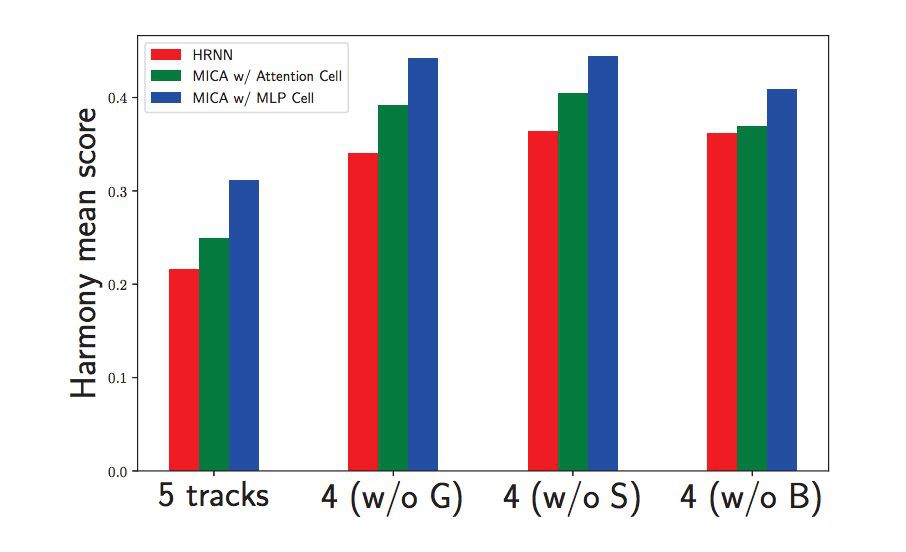

給定一張影象,我們首先要從影象中提取一些呈現物體和情感的關鍵詞。然後基於關鍵字在人類所作詩歌中的關聯性擴展出相關關鍵詞。最後,使用現有詩歌訓練的迴圈神經網路模型來逐漸從關鍵字生成詩句。

我們的方法由人類評估人員進行評估,並與其它基準進行比較。結果表明,我們的作詩方法比其他基準方法更有藝術性。自 2017 年 7 月發行以及詩歌總集釋出以來,這一體系已經為使用者創作了一千二百萬的詩歌。

論文貢獻

-

我們介紹一種創新的應用來用影象去激發現代詩歌的創作,這是在模仿人類受到景物觸動而抒發情感的創作行為。

-

為了創作高質量的詩歌,我們結合了幾種驗證機制來驗證文字的流暢性,詩歌的完整性以及影象的匹配度。

-

我們利用關鍵詞擴充套件來提高詩歌創作的多樣性,使其更富想象力。

論文模型 & 效果

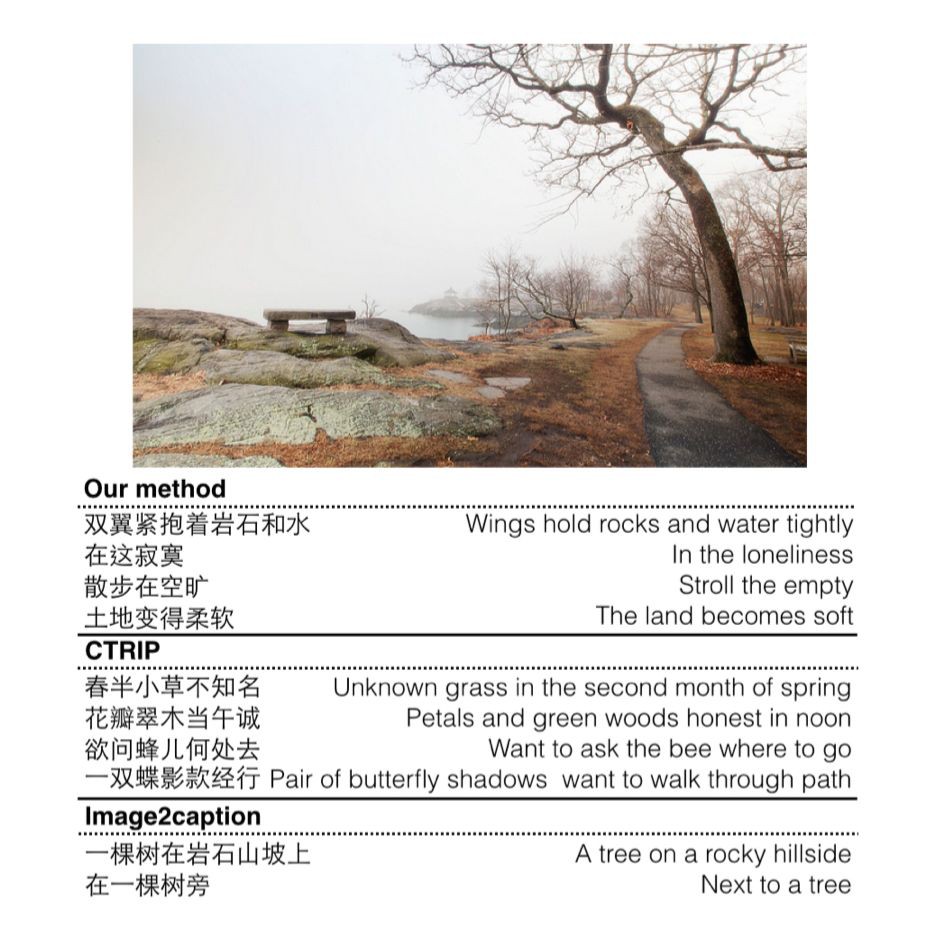

▲ 圖1. 詩歌框架的影象說明。該系統接受使用者所提供的影象並輸出語意相關的中國現代詩歌片段。對於該圖左側部分,其實關鍵字從物體和情感識別器獲得之後,運用關鍵字過濾和擴充套件來生成關鍵詞集。在此之後,如詩歌生成部分顯示,關鍵詞集中的每個關鍵詞被認為是每行詩的一顆種子。提出一種多層生成樣式來保持句子的流暢和連貫。另外,用自動鑒別器來選擇高品質的句子。

▲ 圖2. 我們提出的層級詩歌樣式包括LSTM的兩個級別。在該圖的後半部分說明瞭詩歌水平樣式,透過所有前面的句子來預測下一個句子的內容載體。此後,該圖的上半部分內容載體被認作句子級別LSTM的輸入。註意該圖僅僅顯示的是迴圈生成的反向生成器。正向生成的例子可以透過正序句子級別的生成樣式來達到。

▲ 圖3. 人工測評工具旨在捕捉方法之間的相對判斷。對於每個影象,每種方法都會生成一首四行詩,並且所有的詩都會併排顯示。

▲ 表1. 我們的詩歌生成器在句子水平和詩歌水平上的人工測評結果。平均分數表明遞迴策略和層級模型都得到顯著改善(p值小於0.01)。

▲ 表2. 不同關鍵字擴充套件方法的效能。雖然它們共享接近的平均分,但是透過應用基於詞共現的查詢擴充套件,關鍵詞和句子無關性率都下降。

▲ 圖4. 由兩個基線方法和我們提出的方法生成的示例詩。

▲ 表3. 我們的方法和其他兩個基線的人工測評結果。雖然“相關性”方面由Image2caption佔優,而CTRIP在“流暢”部分更強,但我們的方法在其他方面明顯優於兩個基線。

超越敘事描述

論文摘要

根據影象自動生成自然語言的技術引起了廣泛關註。本文中,我們更進一步,研究如何從影象生成詩歌語言,進行自動的詩歌創作。這一工作涉及多項挑戰,包括發現影象中的詩歌線索(例如,綠色中蘊含的希望),以及生成詩歌——既滿足於影象的相關性,又滿足語言層面上的詩意。

為解決上述問題,我們透過策略梯度將詩歌生成工作劃分成了兩個相關的多對抗訓練子任務,從而保證跨模態相關性和詩歌語言風格。為了從影象中提煉詩歌線索,我們提出學習深度耦合的視覺詩意嵌入,在其中,機器可以連帶地學習影象中物品、情感和場景的詩意呈現。本文還介紹了兩種指導詩歌生成的判別網路,包括多模態判別器和詩歌風格判別器。

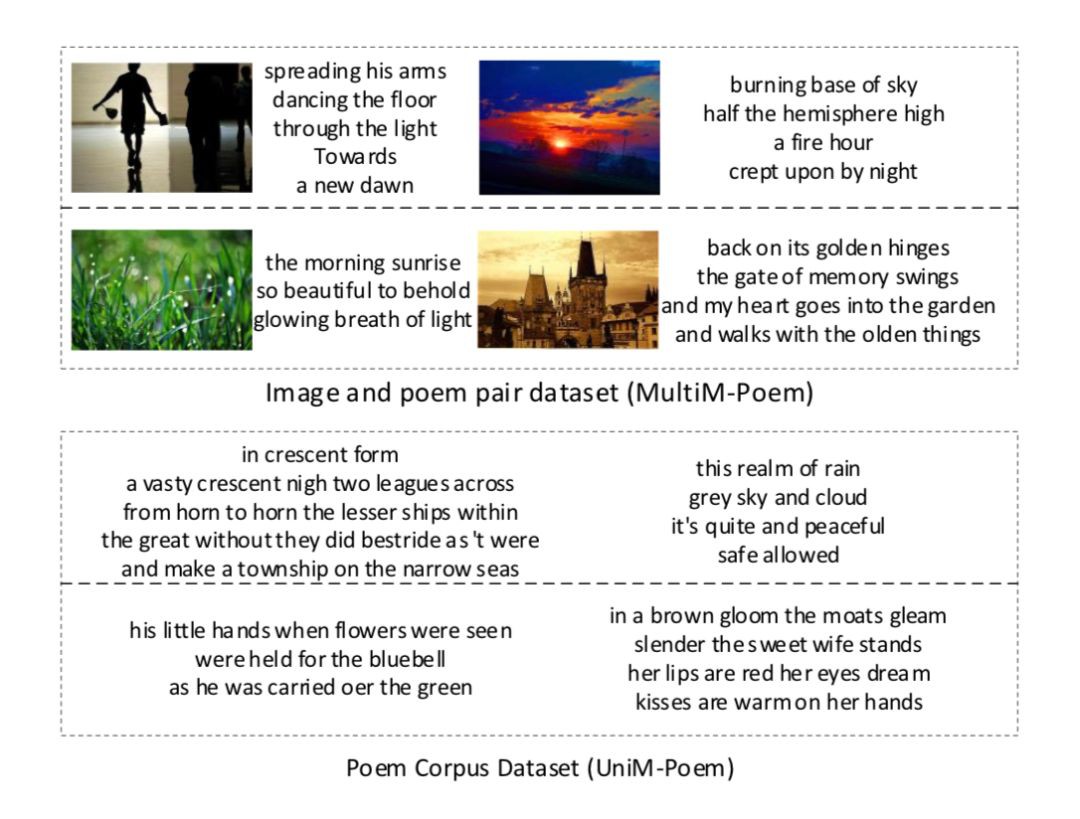

為了便於研究,我們透過人工註解者收集了兩個詩歌資料集,它們有如下性質:1)第一個是人類註解的“影象-詩歌”對資料集(共 8,292 對),以及 2)迄今為止最大的公共英文詩歌語料資料集(共有 92,265 首不同的詩歌)。

我們應用自己的模型生成了八千張影象,進行了大規模的實驗,其中一千五百張影象是隨機選取來進行評估的。客觀評估和主管評估均顯示,該方法相對於目前最先進的影象生成詩歌方法,表現優異。我們請 500 名人類受試者來進行了圖靈測試,其中 30 名評估者是詩歌方面的專業人士,測試結果證明瞭我們方法的有效性。

論文貢獻

-

我們提出以自動方式從影象生成詩歌(英文自由詩)。就我們所知,這是首個嘗試在整體框架中研究影象生成英文自有詩歌問題的努力,它使機器在認知工作中能夠具備接近人類的能力。

-

我們將深度耦合的視覺詩意嵌入模型與基於 RNN 的聯合學習生成器結合,其中兩個判別器透過多對抗訓練,為跨模態相關性和詩意提供獎勵。

-

我們收集了首個人類註解的影象-詩歌對資料集,以及最大的公共詩歌語料資料集。透過應用自動和人工評價標準(包括對 500 多位人類受試者進行的圖靈測試),大量實驗證明,相對於幾個基線方法,我們的方法更為有效。為了更好地促進影象生成詩歌的研究,我們將在不遠的將來公佈這些資料集。

論文模型 & 效果

▲ 圖1. 示例-人類對相同影象寫出的描述和詩歌。我們可以看到,這兩種形式中相同顏色的用詞有著明顯差異。相對於描述影象中的事實,詩歌更傾向於捕捉影象中物體、場景和感情更深層次的含義和是個象徵(例如,騎士與獵鷹,獵和發與進食,以及待與站)。

▲ 圖2. 使用多對抗訓練進行詩歌生成的架構。我們首先使用人類註解配對的影象-詩歌資料集(多模態詩集)中的影象-詩歌對 (a) 來訓練深度耦合的視覺詩意嵌入模型 (e)。詞性分析器(斯坦福大學 NLP 工具)從詩歌中提取詩歌象徵(例如物品、場景和情感),影象特徵 (b) 即為使用提取的這些象徵對 CNN 進行微調後取得的詩歌多 CNN 特徵。詩歌的陳述句特徵 (d) 是從受到最大公共詩歌語料庫(單模態詩集)訓練的 skip-thought 模型 (c) 中提取得到的。基於 RNN 的陳述句生成器 (f) 作為智慧體得到訓練,兩種判別器(評判根據給定影象生成的詩歌的多模態 (g) 和詩歌風格 (h) )為策略梯度 (i) 提供獎勵。詞性分析器從是各種提取詞性詞語。

▲ 圖3. 兩個資料集中的示例:單模態詩集和多模態詩集

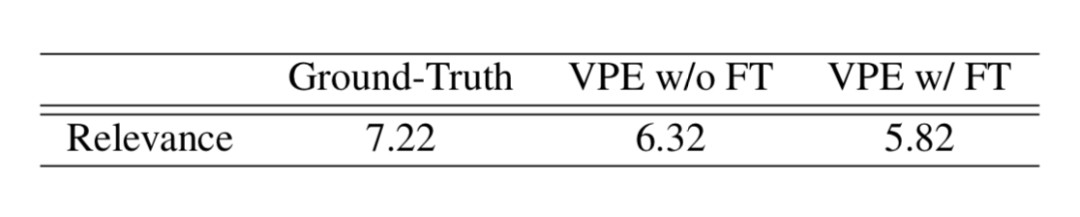

▲ 表1. 三個資料集的詳細資訊。前兩個資料集由我們自己收集,第三個透過VPE擴充套件而得。

▲ 圖4. 使用六種方法根據一幅影象生成詩歌的示例。

▲ 表2. 人類創作的三種型別詩歌與影象相關性的平均得分,評分範圍0-10分(0分-不相關,10分-相關)。單向方差分析顯示,這些詩歌的評價具有統計學意義(F(2, 9)=130.58, p<1e-10)。

▲ 圖5. 透過我們12P-GAN方法生成詩歌的示例。

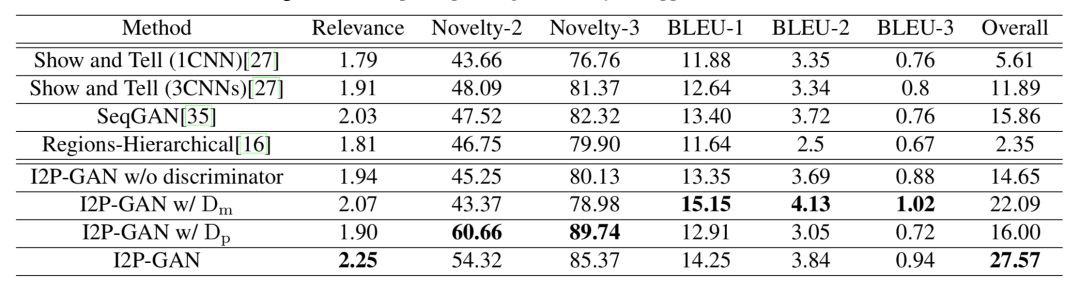

▲ 表3. 自動評價。請註意,BLEU得分是比較人類註解的真實詩歌計算出的分數(一首詩歌對應一幅影象)。總分是三種標準歸一後的平均值計算得出的。所有得分都是百分比(%)。

▲ 表4. 六種方法在四個標準下的人類評價結果:相關性(Rel)、連貫性(Col)、想象力(Imag)和總分。所有標準的評分範圍都是0-10分(0-差,10-優)。

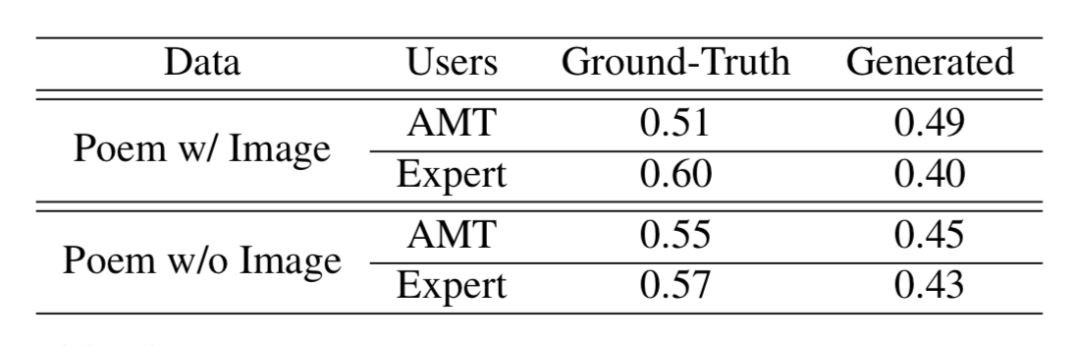

▲ 表5. 使用詩歌搭配影象/不搭配影象、對ATM使用者和專家使用者進行的圖靈測試的準確性。

點選標題檢視更多論文解讀:

#投 稿 通 道#

#投 稿 通 道#

讓你的論文被更多人看到

如何才能讓更多的優質內容以更短路徑到達讀者群體,縮短讀者尋找優質內容的成本呢? 答案就是:你不認識的人。

總有一些你不認識的人,知道你想知道的東西。PaperWeekly 或許可以成為一座橋梁,促使不同背景、不同方向的學者和學術靈感相互碰撞,迸發出更多的可能性。

PaperWeekly 鼓勵高校實驗室或個人,在我們的平臺上分享各類優質內容,可以是最新論文解讀,也可以是學習心得或技術乾貨。我們的目的只有一個,讓知識真正流動起來。

? 來稿標準:

• 稿件確系個人原創作品,來稿需註明作者個人資訊(姓名+學校/工作單位+學歷/職位+研究方向)

• 如果文章並非首發,請在投稿時提醒並附上所有已釋出連結

• PaperWeekly 預設每篇文章都是首發,均會新增“原創”標誌

? 投稿郵箱:

• 投稿郵箱:hr@paperweekly.site

• 所有文章配圖,請單獨在附件中傳送

• 請留下即時聯絡方式(微信或手機),以便我們在編輯釋出時和作者溝通

?

現在,在「知乎」也能找到我們了

進入知乎首頁搜尋「PaperWeekly」

點選「關註」訂閱我們的專欄吧

關於PaperWeekly

PaperWeekly 是一個推薦、解讀、討論、報道人工智慧前沿論文成果的學術平臺。如果你研究或從事 AI 領域,歡迎在公眾號後臺點選「交流群」,小助手將把你帶入 PaperWeekly 的交流群裡。

▽ 點選 | 閱讀原文 | 獲取最新論文推薦

知識星球

知識星球