在碎片化閱讀充斥眼球的時代,越來越少的人會去關註每篇論文背後的探索和思考。

在這個欄目裡,你會快速 get 每篇精選論文的亮點和痛點,時刻緊跟 AI 前沿成果。

點選本文底部的「閱讀原文」即刻加入社群,檢視更多最新論文推薦。

本期推薦的論文筆記來自 PaperWeekly 社群使用者 @Cratial。為了結合用戶的內部大腦活動和外部潛意識行為,本文提出了使用 6 個 EEG 電極和眼動追蹤眼鏡來識別人類情緒的多模態框架 EmotionMeter。

如果你對本文工作感興趣,點選底部閱讀原文即可檢視原論文。

關於作者:吳仕超,東北大學碩士生,研究方向為腦機介面、駕駛疲勞檢測和機器學習。

■ 論文 | EmotionMeter: A Multimodal Framework for Recognizing Human Emotions

■ 連結 | https://www.paperweekly.site/papers/2000

■ 作者 | Wei-Long Zheng / Wei Liu / Yifei Lu / Bao-Liang Lu / Andrzej Cichocki

引出主題

不同模態方法描述了情緒的不同方面,並且包含互補資訊。以融合技術將這些資訊結合起來可以構建魯棒性更強的情緒識別模型。

目前,大多數的研究都集中在聽覺和視覺模態相結合的多樣式情緒識別上,然而,來自中樞神經系統,例如 EEG 訊號和外部行為,例如眼球運動的多模態結合已被證明是對情緒識別更加有效的方法。

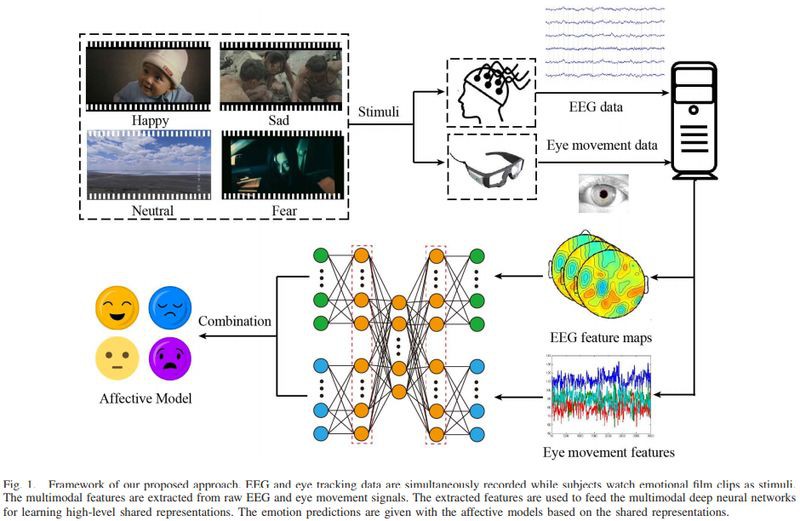

為了結合用戶的內部大腦活動和外部潛意識行為,本文提出了使用 6 個 EEG 電極和眼動追蹤眼鏡來識別人類情緒的多模態框架 EmotionMeter。本文提出的情緒識別系統的框架如圖 1 所示。

▲ 圖1

本文工作:本文設計了一種包含 6 個對稱顳葉電極的電極放置方式,可以很容易地嵌入到耳機或眼鏡框架中。為驗證本文演演算法的有效性,設計了四種情緒(高興、悲傷、恐懼和中性)的識別實驗。

本文揭示了 EEG 訊號和眼動資訊對於情緒識別的互補特性,並透過使用多模態深度神經網路改善了系統的識別效能。本文運用來自不同實驗階段的訓練和測試資料集研究了本文方法的穩定性,並證明瞭在多次實驗內和實驗之間的穩定性。

實驗設計

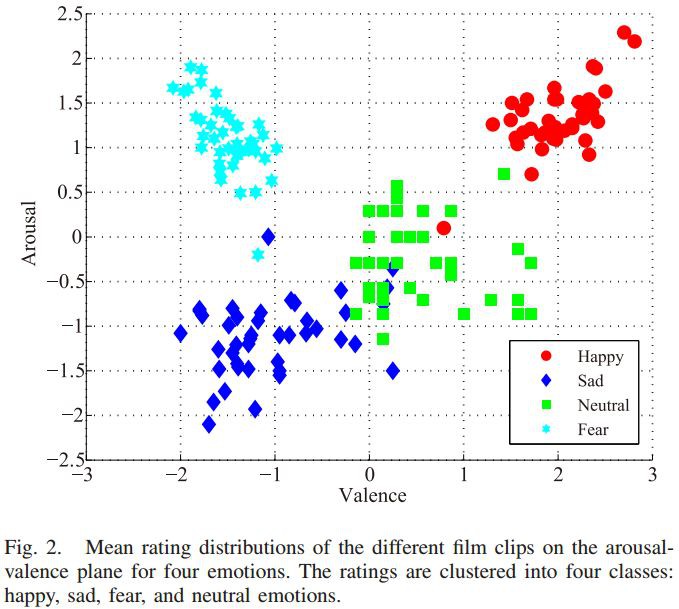

在我們的材料庫中,共有 168 個包含四種情緒的電影片段,44 位被試(22 位女性,均為大學生)被要求在觀看電影片段時評估他們的情緒狀態(在 valence 和 arousal 兩個維度下進行評分(-5~5))。

不同電影片段的平均得分分佈情況如圖 2 所示。從圖中可以看出,不同情緒狀態的電影片段在 valence 和 arousal 兩個維度下的得分情況存在顯著差異。

▲ 圖2

最後,本文從材料庫中精心挑選出 72 個認同度最高的電影片段用於情緒誘發實驗。每個電影片段時長約為 2 分鐘。為了避免重覆,每個電影片段只被用於一次實驗。

為了研究本文模型在一段時間內的穩定性,我們在不同的時間為每位被試設計了三個不同的實驗(sessions)。每次實驗(session)包含 24 個刺激片段(trials),其中每類情緒有 6 個刺激片段(trials),並且三次實驗所用的刺激片段完全不同。圖 3 給出了本文實驗的詳細設計流程。

▲ 圖3

資料記錄實驗共包括 15 名(8 名女性,年齡在 20~24 歲)被試,均為右利手。每位被試參與實驗 3 次,共獲得 45 次實驗資料。本文使用的資料集(SEED-IV)將作為 SEED [1] 的子集可免費獲得用於學術研究。

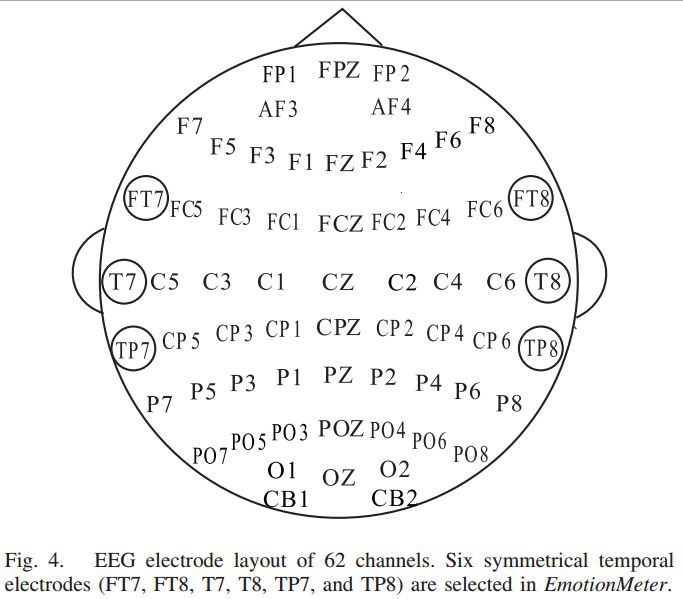

根據國際 10-20 電極系統,本文選擇顳葉對稱的六個電極(FT7, FT8, T7, T8, TP7, TP8)進行實驗。電極佈局如圖 4 所示。

▲ 圖4

為了進行對比,本文同時記錄了 62 通道的 EEG 資料。原始 EEG 資料用 ESI NeuroScan 系統以 1000hz 的採用頻率進行採集,並同時運用 SMI ETG eye-tracking glasses 記錄眼動資訊。圖 5 顯示了本文系統的硬體設定。

▲ 圖5

研究方法

預處理

儘管瞳孔直徑與情緒處理有關,但它很容易受到環境亮度的影響。基於不同被試對相同刺激的瞳孔反應變化具有相似樣式的觀察結果,我們應用基於主成分分析(PCA)的方法來估計瞳孔亮度反射。對於 EEG 訊號,本文運用 1~75Hz 的帶通濾波器去除偽跡,並對 EEG 和眼動資料進行重取樣以降低計算複雜度。

特徵提取

針對 EEG 訊號,根據我們以前的研究,本文運用短時傅裡葉變換(STFT)和 4s 長度的視窗以非重疊的方式提取功率譜密度(PSD)和微分熵(differential entropy, DE)兩類特徵。

針對所有通道的五個頻帶我們計算了 PSD 和 DE 特徵:1) delta: 1-4Hz; 2) theta: 4-8Hz; 3) alpha: 8-14Hz; 4) beta: 14-31 Hz; and 5) gamma: 31-50Hz。

對於兩個電極(T7和T8),四個電極(T7,T8,FT7和FT8)和六個電極(T7,T8,FT7,FT8,TP7和TP8)的 PSD 和 DE 特徵的尺寸分別為 10,20 和 30。

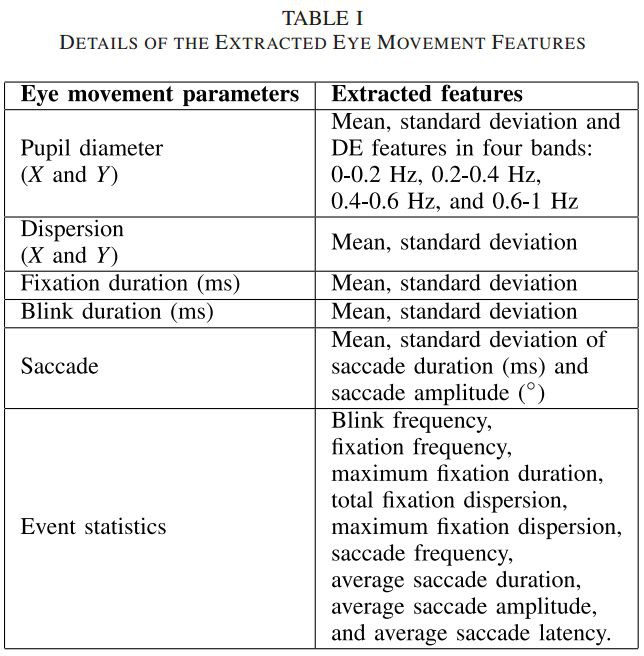

我們應用線性動態系統(linear dynamic system)方法來濾除與 EEG 特徵無關的噪聲和偽跡。表 1 中顯示了從眼球運動資料中提取的各類特徵資訊。

▲ 表1

眼動特徵的維度為 33,圖 6 顯示了 5 類眼動引數。

▲ 圖6

分類方法

我們使用支援向量機(線性核)作為基準分類器,準確度和標準差被用於評估分類效能。本文采用特徵級融合作為模態融合的基準,將腦電圖和眼動特徵向量直接連線成一個較大的特徵向量作為分類器的輸入。

對於單一模態和多模態的實驗評估,我們將一次實驗的資料分為訓練資料和測試資料,其中前 16 個刺激片段(trials)是訓練資料,最後 8 個刺激片段(trials)(每個情緒包含 2 個 trials)是測試資料。

為了分析 session 之間效能的一致性,將一個 session 的資料用作訓練資料,並將另一個 session 的資料用作測試資料。

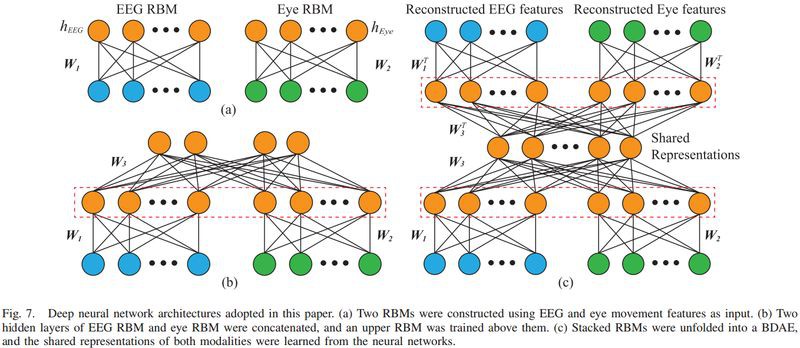

多模態深度學習

為了提高識別效能,我們採用雙峰深度自動編碼器(bimodal deep auto-encoder, BDAE)來提取腦電圖和眼球運動的共有表示。圖 7 描述了本文提出的深度神經網路的結構。

▲ 圖7

實驗結果與分析

基於EEG訊號的情緒識別

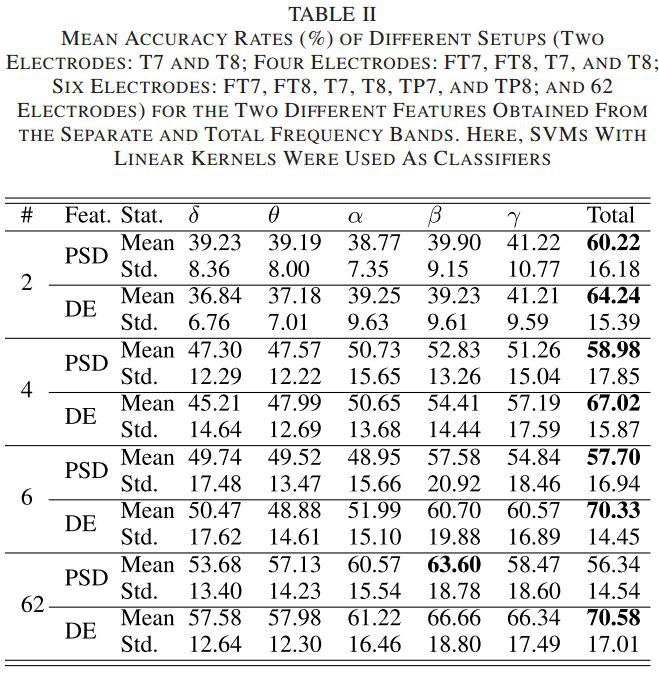

首先,我們評估了 EmotionMeter 在不同腦電電極配置下的識別準確率,實驗結果如表 2 所示。“total”表示五個頻帶特徵的直接級聯。

▲ 表2

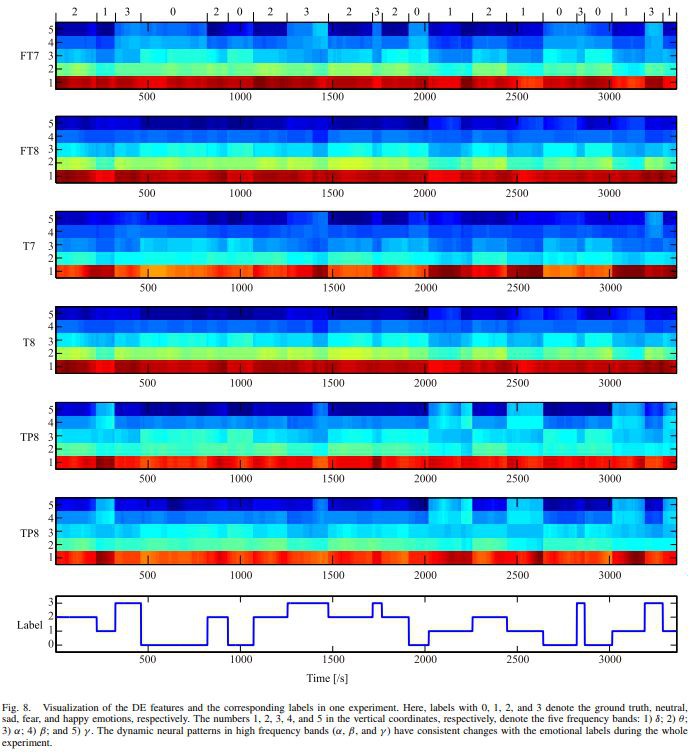

一次實驗中,DE 特徵的視覺化顯示和對應的情緒標簽如圖 8 所示,圖中呈現了高頻特徵中的動態神經樣式。從圖中可以看出,delta 的 DE 特徵沒有顯示出明顯的變化,而 gamma 和 beta 反應與情緒標簽具有一致性。

▲ 圖8

互補特性分析

對於僅使用眼動資料的情緒識別,我們獲得的平均準確度和標準偏差為 67.82%/ 18.04%,略低於僅使用 EEG 訊號獲得的識別結果(70.33%/ 14.45%)。

對於模態融合,本文比較兩種方法:1)特徵級融合和2)多模態深度學習。對於特徵級融合,EEG 和眼動資料的特徵向量直接連線成一個較大的特徵向量作為 SVM 的輸入。

表 III 顯示了每種單一樣式(眼球運動和腦電圖)和兩種模態融合方法的表現,圖 9 顯示了使用不同模態的準確度盒形圖。

▲ 表3

▲ 圖9

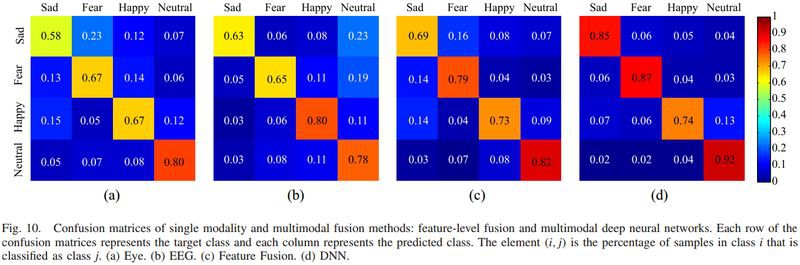

為了進一步研究腦電圖和眼動資料的互補特徵,我們分析了每種模態的混淆矩陣,揭示了每種模態的優缺點。圖 10 和圖 11 分別給出了基於眼動資料和腦電圖的混淆圖和混淆矩陣。實驗結果表明腦電和眼動資料對情緒識別具有不同的判別力。結合這兩種樣式的互補資訊,模態融合可以顯著提高分類精度(85.11%)。

▲ 圖10

▲ 圖11

各session之間的穩定性分析

我們選擇來自相同被試的不同 session 的總頻帶 DE 特徵和眼動資料特徵,構成訓練和測試資料集。表 IV 列出了兩個,四個和六個電極配置下的平均識別準確率和標準差。這些結果證明瞭 EmotionMeter 框架的相對穩定性。

▲ 表4

結論與分析

情緒可以透過內部生理反應和外部行為表現出來。來自不同模態的訊號從不同方面表徵了情緒狀態,並且來自不同模態的互補特徵可以進行融合以構建比單模態方法魯棒性更強的情緒識別系統。本文提出的情緒識別框架 EmotionMeter 就是一種融合 EEG 訊號和眼動資料的多模態情緒識別系統。

本文由 AI 學術社群 PaperWeekly 精選推薦,社群目前已改寫自然語言處理、計算機視覺、人工智慧、機器學習、資料挖掘和資訊檢索等研究方向,點選「閱讀原文」即刻加入社群!

點選標題檢視更多論文解讀:

▲ 戳我檢視招募詳情

#作 者 招 募#

#作 者 招 募#

關於PaperWeekly

PaperWeekly 是一個推薦、解讀、討論、報道人工智慧前沿論文成果的學術平臺。如果你研究或從事 AI 領域,歡迎在公眾號後臺點選「交流群」,小助手將把你帶入 PaperWeekly 的交流群裡。

▽ 點選 | 閱讀原文 | 檢視原論文

知識星球

知識星球