Hi,各位煉丹師

聽說還有不到0.5天

我就要開啟快樂肥宅樣式了

你的國慶長假都有哪些安排呢?

景區看人,開車堵車,

回家被嫌棄,單身還要出份子錢,

這些國慶常規 bug,你真的想要嗎……

為了幫你合理安排國慶假期

小編連夜整理了一份最新論文清單

希望你們都能從中找到些許小靈感

請看

↓

@zhoujie17 推薦

@zhoujie17 推薦

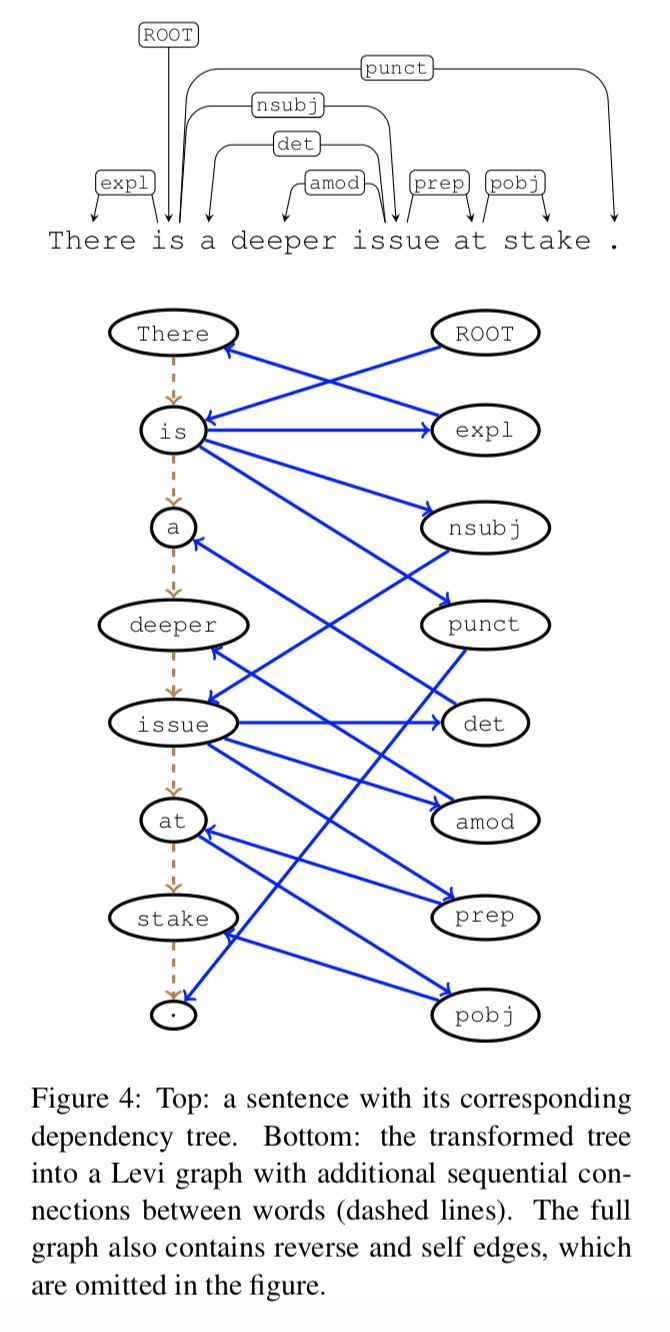

#Graph-to-Sequence Learning

本文提出了一種新的 encoder-decoder 框架來進行 graph-to-sequence 即圖到序列的學習,在 AMR 圖的序列生成和基於句法的神經機器翻譯任務上取得了較好的結果。本文提出的方法解決了之前工作中存在的問題,包括將圖結構線性化造成的資訊丟失以及引數爆炸問題。

本文提出了一種圖的轉換方法,透過將圖轉換為 Levi 圖從而解決了上述問題。同時該框架將 Gated Graph Neural Network 加入到 encoder 部分,其餘部分採用 seq2seq 的原始結構,在兩個任務上取得了超越了 seq2seq 的結果。

▲ 論文模型:點選檢視大圖

@paperweekly 推薦

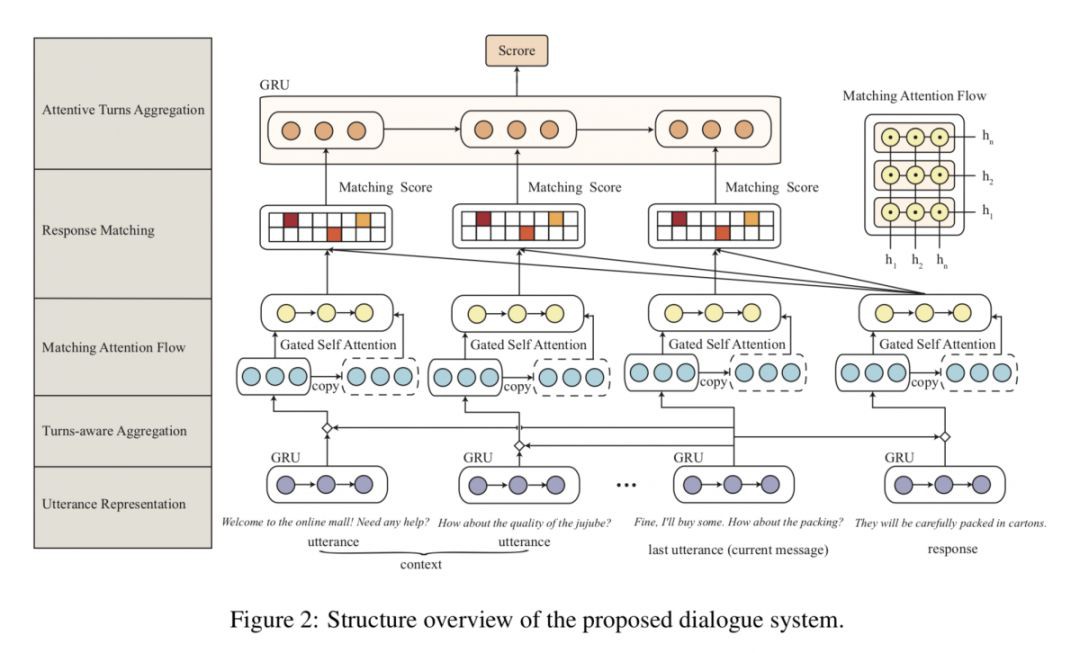

#Dialog Systems

本文是上海交大發表於 COLING 2018 的工作,研究的問題是檢索型對話系統。論文提出了一個深度對話整合模型,解決了以往對話理解模型中將多句對話話語直接拼接而忽略話語間關係的問題。

具體來說,論文模型將過往對話整合到 context 中,根據話語和回覆挖掘關鍵資訊,然後將每一個過往話語與回覆進行語意匹配得到匹配分數。其中將最重要的回覆前最後一句話語(可視為 query),與其他過往話語的向量表示進行了融合,並透過編碼使每句話語中的關鍵資訊得到凸顯、過濾冗餘資訊。

▲ 論文模型:點選檢視大圖

@guohao916 推薦

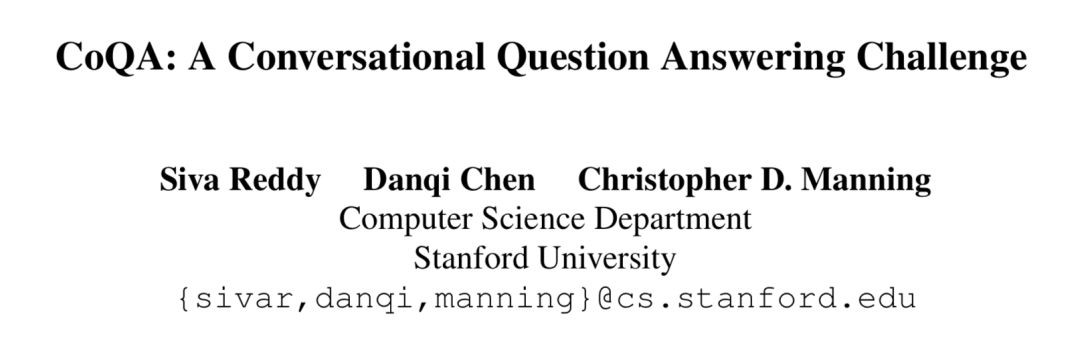

#Machine Reading Comprehension

生活中,人們通常根據一系列相互關聯的問答情況來收集資訊。因此使用基於對話的機器閱讀理解可以更有利於資訊的收集。針對該場景,本文釋出了一個基於對話的機器閱讀理解資料集 CoQA。與以往的機器閱讀理解資料集如 SQUAD 不同,該資料集存在以下特點:

1. 與之前資料集中答案通常存在於篇章的句子片段中的情況不同,該資料集在生成過程中儘量避免使用句子中已經存在的短語或者片段,以短語或者片段的同義詞或者同義片段的形式呈現;

2. 問題的答案中存在自由形式的短語片段,即需要對多條篇章句子加以歸納總結;

3. 篇章分別來自一系列不同的領域;

4. 和多輪對話的情況類似,問答對呈現出連續多輪的特點,平均輪數為 15 輪。問答對呈現出序列性的依賴關係。

該問題可以看成對話系統和問答系統的一個綜合性的應用。論文使用多種基準演演算法進行對比實驗,包括 Seq2Seq, PGNet, DrQA 以及 DrQA+PGNet。實驗結果表明效果最優的模型 DrQA+PGNet 依然比人工標註得到的 F1 指標數目要低很多,因此該資料集具有很大的模型提升空間。

▲ 論文模型:點選檢視大圖

@tobiaslee 推薦

#Text Generation

本文是北京大學發表於 NAACL 2018 的工作。論文借鑒了 Attention is All your Need 的思想,透過 Query 的方式來進行文字的生成。

傳統文字生成的方式會使用一層全連線層將隱層狀態對映到詞表上,獲得一個機率分佈,這樣做存在兩個問題:引數量巨大和語言關係的丟失(沒考慮到詞的機率之間的關聯關係)。

本文采用將候選詞作為 value, 而對應的 word embedding 則是 key,透過將 RNN 的輸出作為 query,根據 query 和 embedding 的 similarity 來進行生成詞的選取。

▲ 論文模型:點選檢視大圖

@paperweekly 推薦

#Question Answer Matching

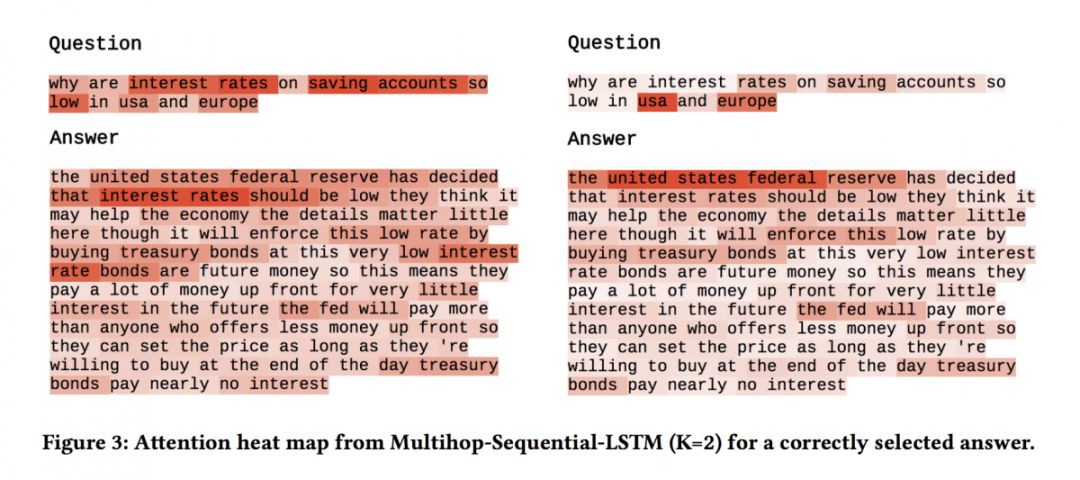

本文是漢諾威大學發表於 SIGIR 2018 的工作。Answer Selection 是 QA 任務中的重要子任務,現有方法往往先透過單個向量對問題和回答進行表示,然後再計算打分。論文提出了一種多階段的 Sequential Attention 機制,將問題進行多次 attention,從而使得能夠在不同階段註意到答案不同的階段,有效處理了長文字語意的表達問題。

實驗表明,本文提出的模型在各主流 QA 資料集(TREC-QA、WikiQA、InsuranceQA、FiQA)上均取得了最優表現。

▲ 論文模型:點選檢視大圖

@mrililili 推薦

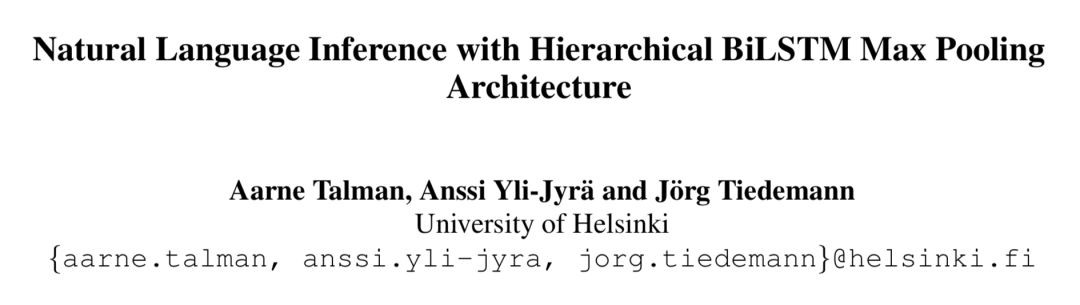

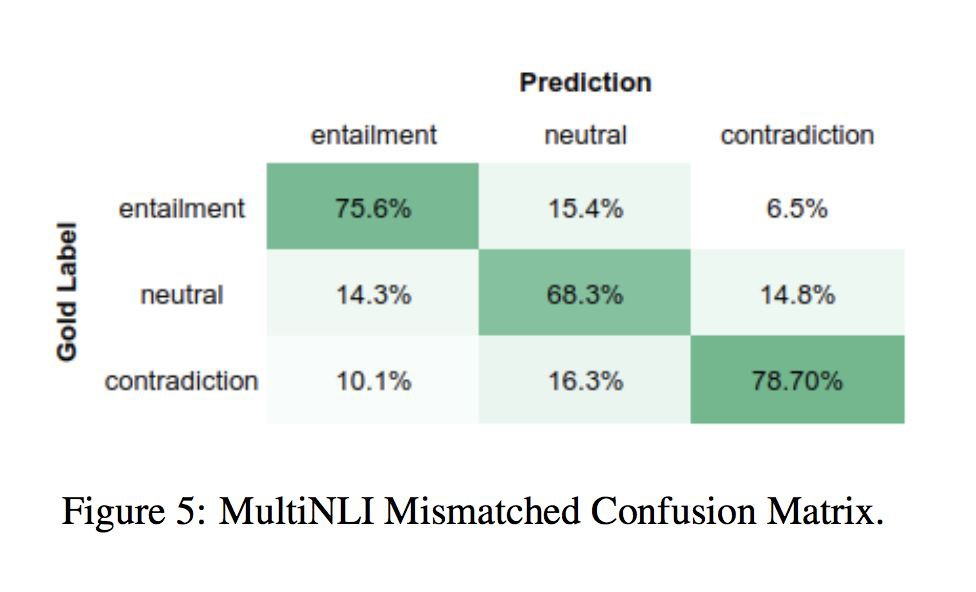

#Natural Language Inference

本文來自赫爾辛基大學,論文主要關註的是自然語言推理任務。作者利用多層雙向 LSTM 進行句子編碼,並用上一個 LSTM 的結果初始化下一個 LSTM,取得了較好的結果。此外,實驗表明本文提出的句子嵌入方法可應用於各類遷移學習任務。

▲ 論文模型:點選檢視大圖

@paperweekly 推薦

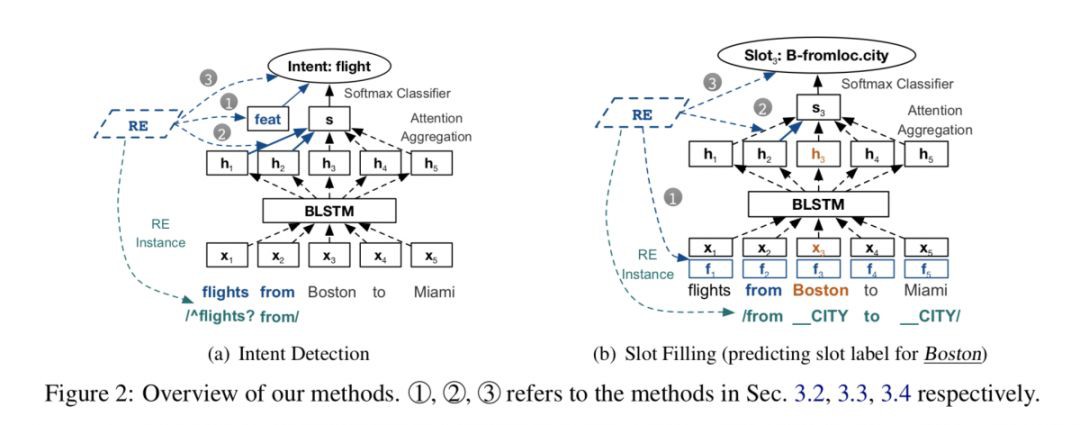

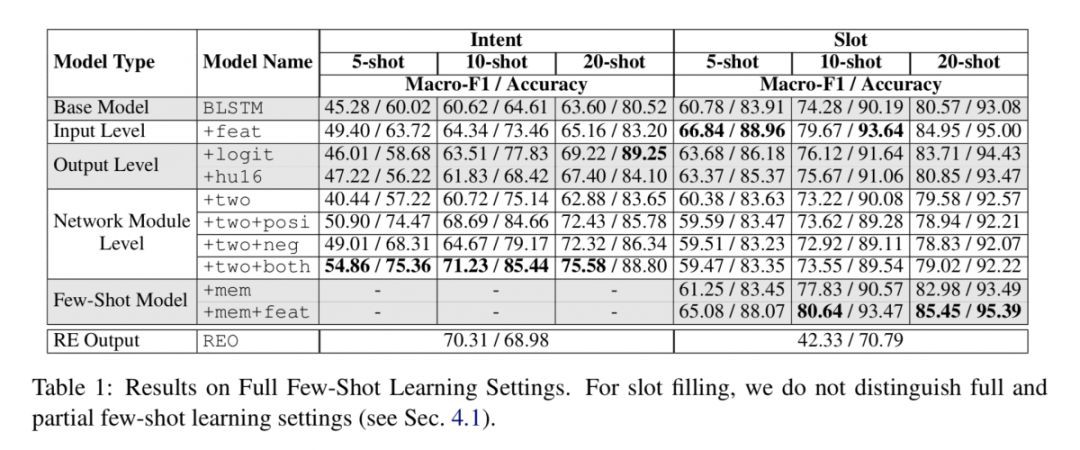

#Natural Language Understanding

自然語言處理任務的成功取決於標註資料的數量和質量,訓練資料不足將直接影響任務精度和準確度。針對文字語料不足的情況,本文提出了一種將神經網路和正則運算式相結合的方法,來改進 NLP 的監督學習。

本文提出的方法在少量學習和完整註釋設定上都明顯提高了神經網路的效能。此外,本文為如何將 REs 與 NNs 和 RE 註釋相結合提供了一套指南。

▲ 論文模型:點選檢視大圖

@lunar 推薦

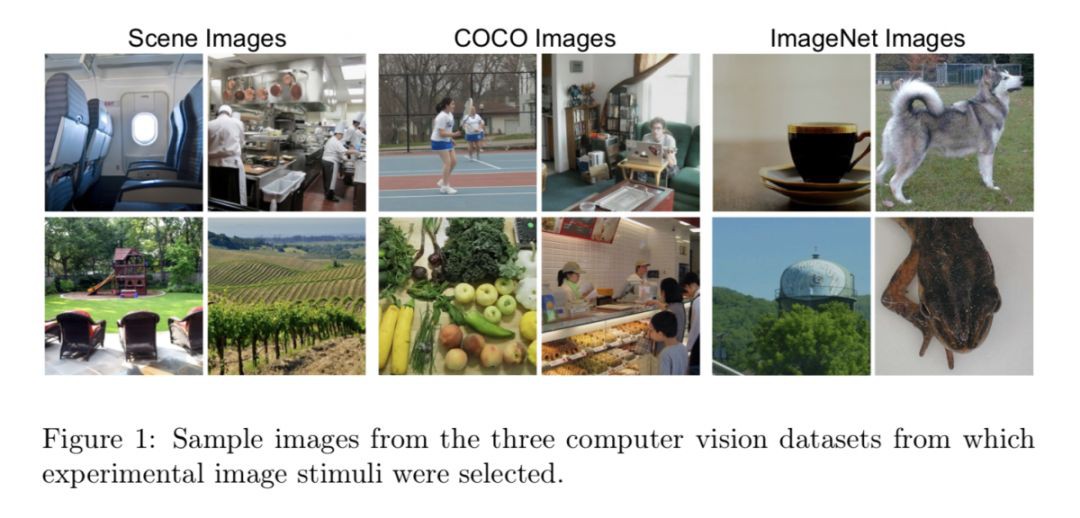

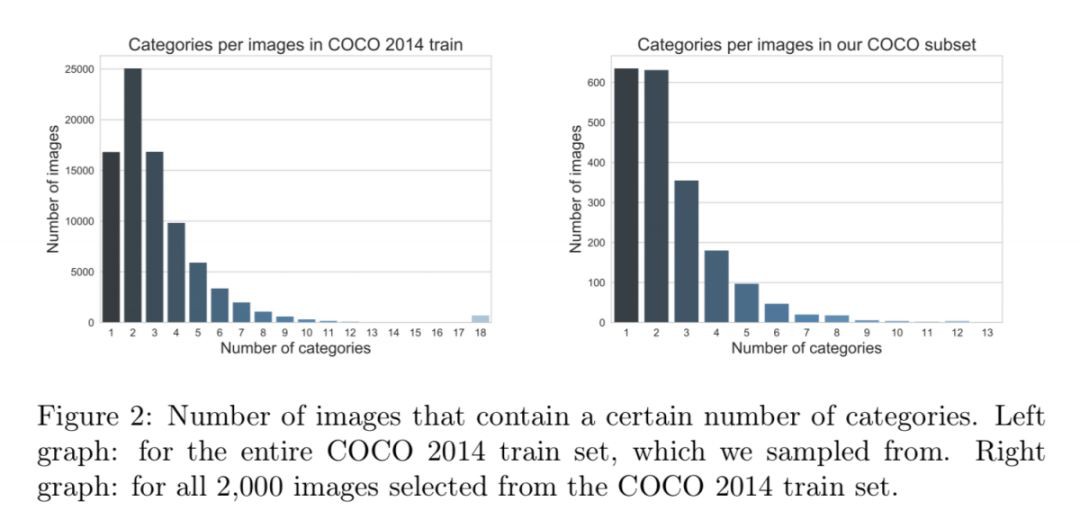

#Dataset Creation

本文是由 CMU 的一眾科學家釋出的一個公開資料集,他們組織了 4 個受試者去觀察 5000 張圖片,併在他們觀察圖片時記錄下當時腦部的核磁共振圖。 透過該資料集,我們可以將人工神經網路和人類神經網路聯合起來分析,可以想象透過這個資料集,可以做出許多有趣的工作。

▲ 論文模型:點選檢視大圖

@paperweekly 推薦

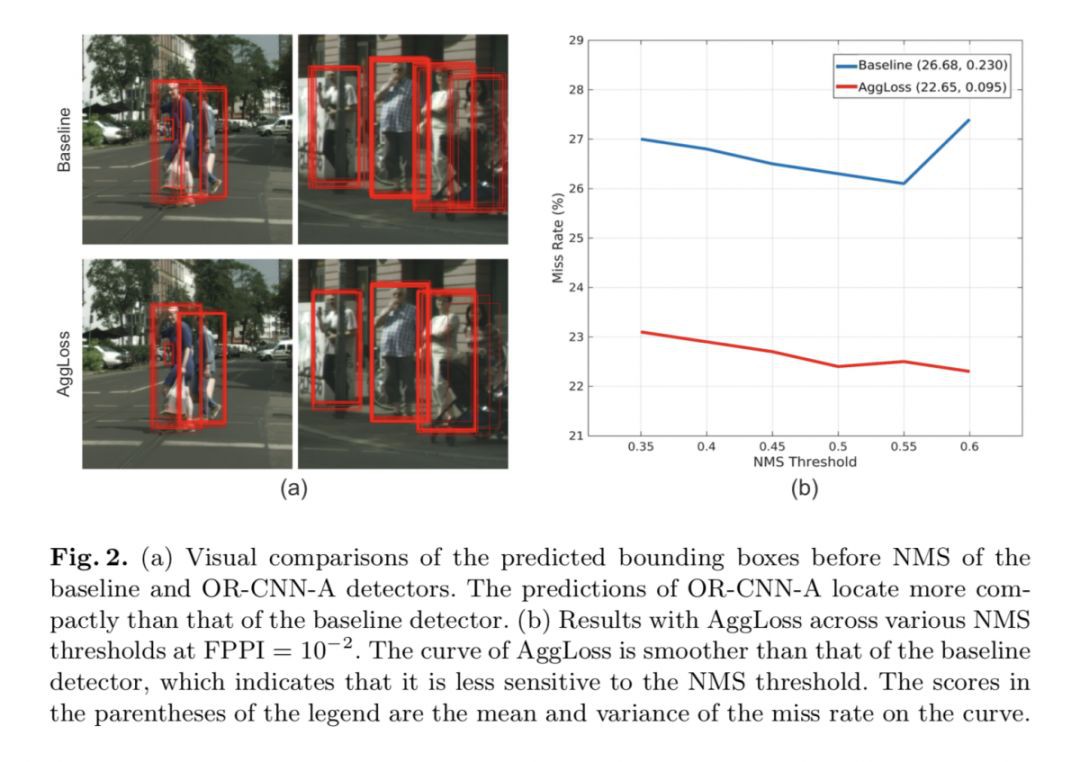

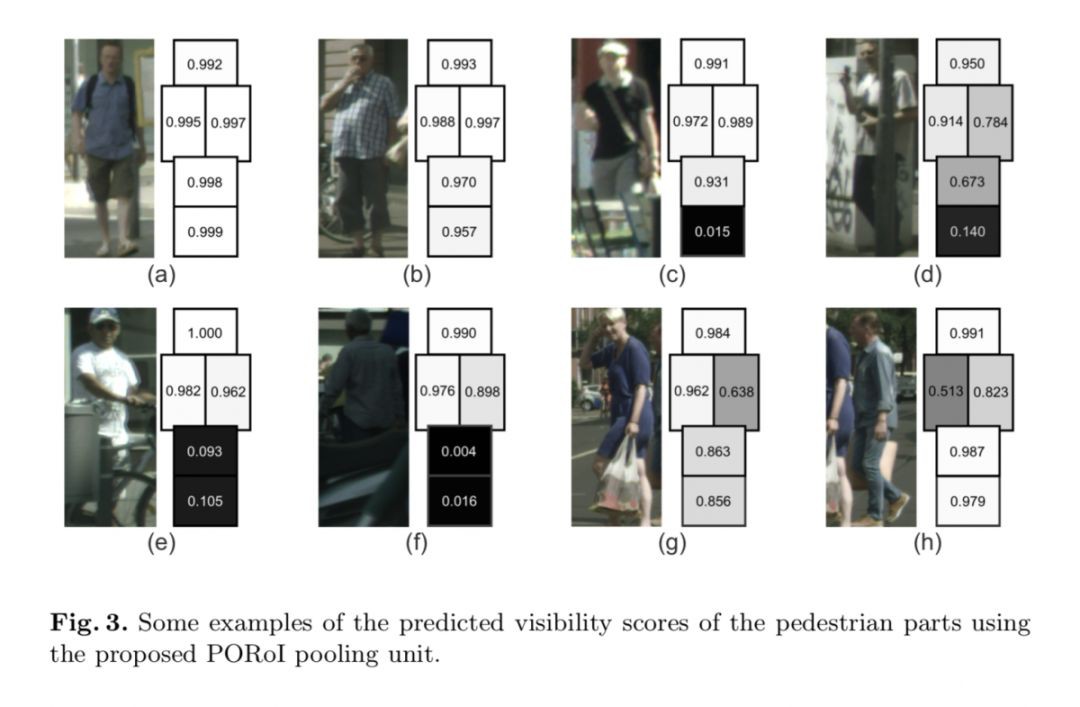

#Pedestrian Detection

本文是中科院自動化發表於 ECCV 2018 的工作。本文重點關註行人檢測中的遮擋問題,併為此提出了兩種遮擋處理策略。作者在Faster R-CNN的基礎上提出了一種全新方法——OR-CNN,其主要包括兩個部分:第一階 段RPN 產生標的候選框,第二階段 Fast R-CNN 對標的候選框進行進一步的分類和回歸。

▲ 論文模型:點選檢視大圖

@paperweekly 推薦

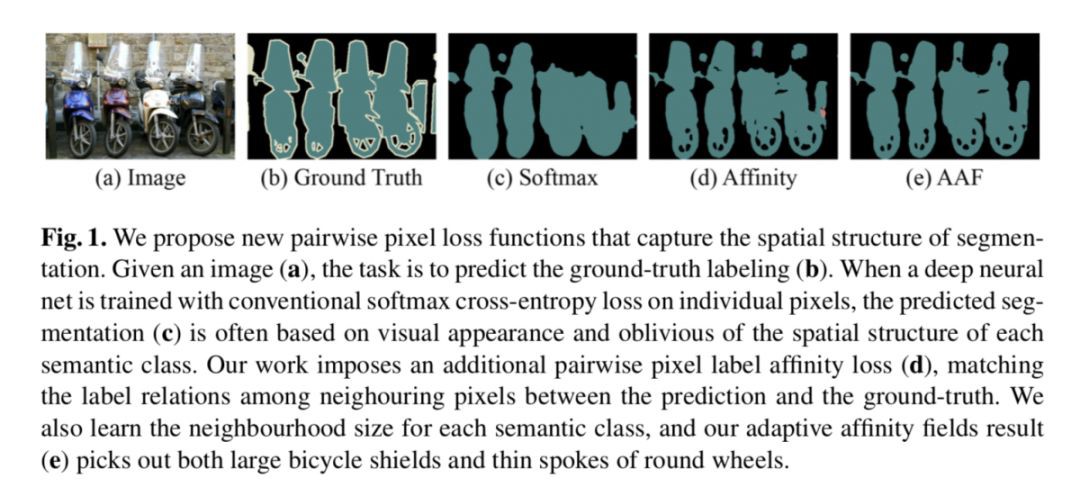

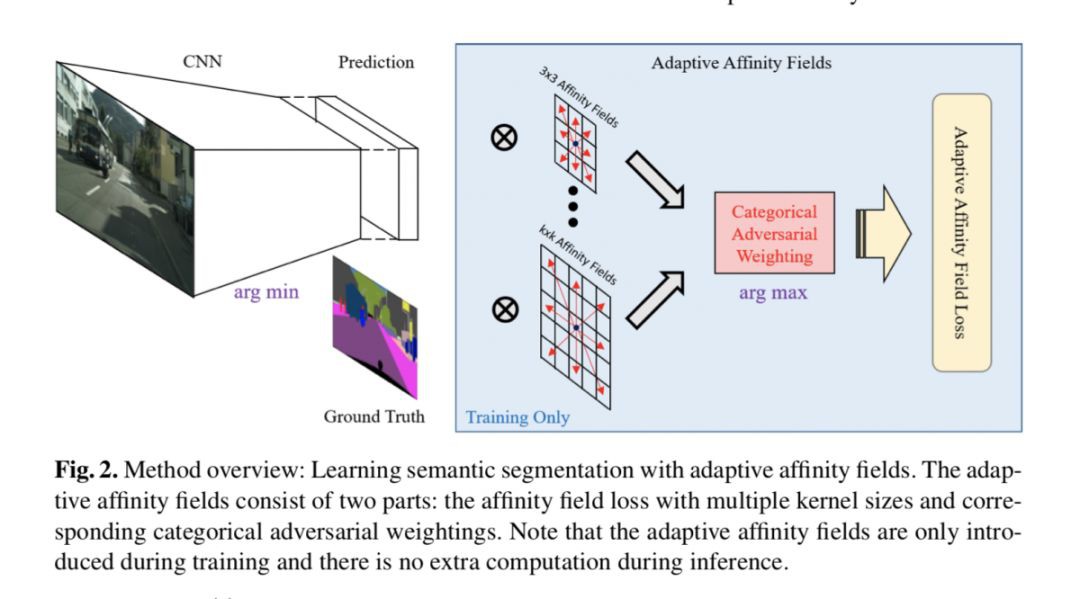

#Semantic Segmentation

本文是 UC Berkeley 發表於 ECCV 2018 的工作,論文提出了一種以自適應相似場(Adaptive Affinity Fields )來輔助語意分割的方法,增強了網路對標的結構推理的能力,取得了非常顯著的效能提升。

此外,本文提出的方法也是一種全新的深度學習結構建模方法,不僅可以用於語意分割,理論上也適用於影象深度估計、光流計算等對影象進行畫素級理解的任何場景。

▲ 論文模型:點選檢視大圖

@paperweekly 推薦

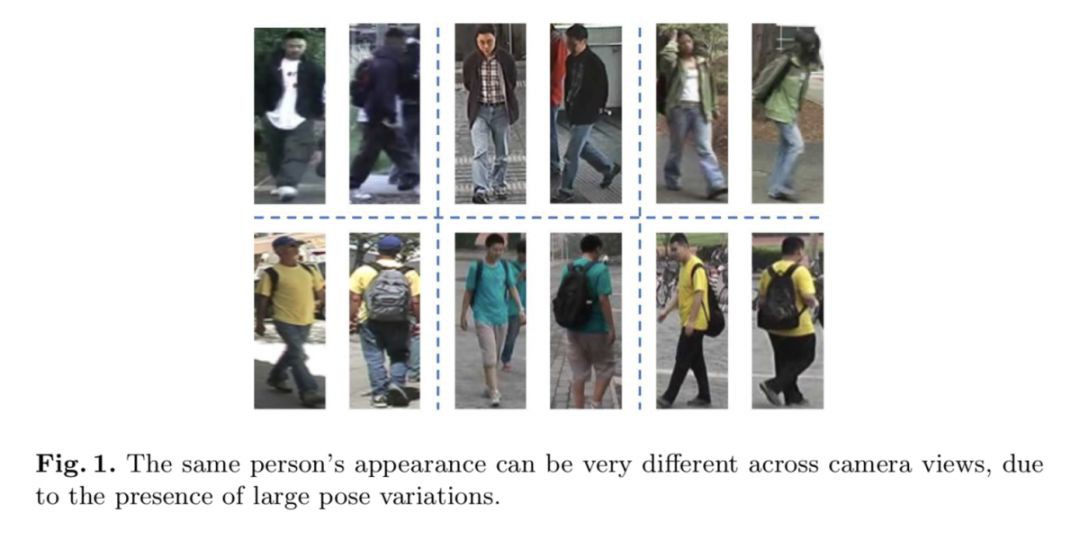

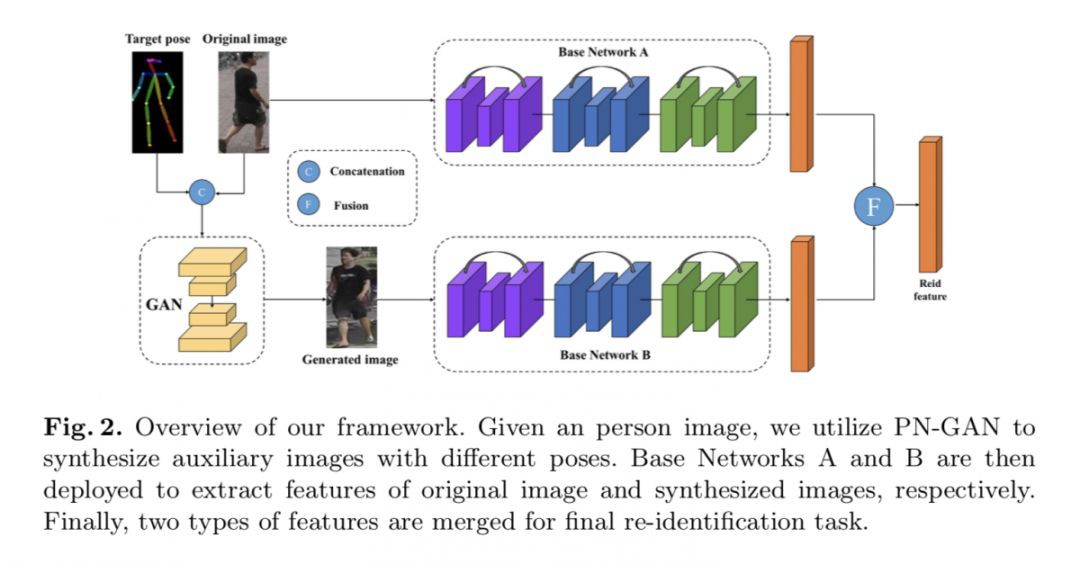

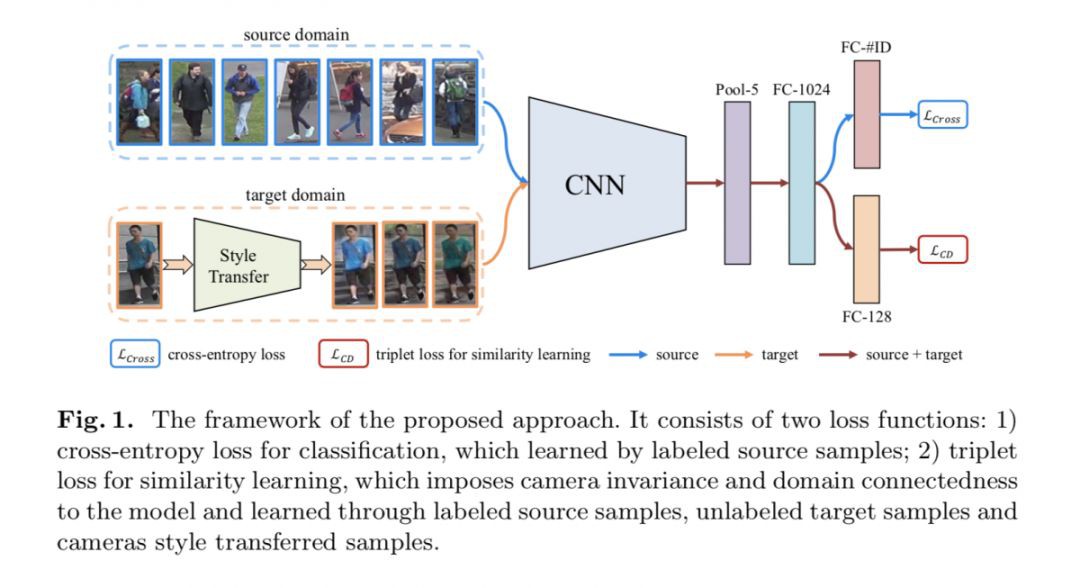

#Person Re-ID

本文是復旦大學發表於 ECCV 2018 的工作,論文主要研究的是行人重識別任務中的人體姿態變化問題。作者利用 GAN 生成新的姿態行人圖片,然後融合原圖和生成圖的 ReID 特徵作為最終特徵。在測試階段,論文定義了八種代表性的姿態,然後生成八張人造圖,加上原圖總共可以得到九個特徵,最後使用 max pooling 得到最終的 ReID 特徵。

▲ 論文模型:點選檢視大圖

@DanielTANG 推薦

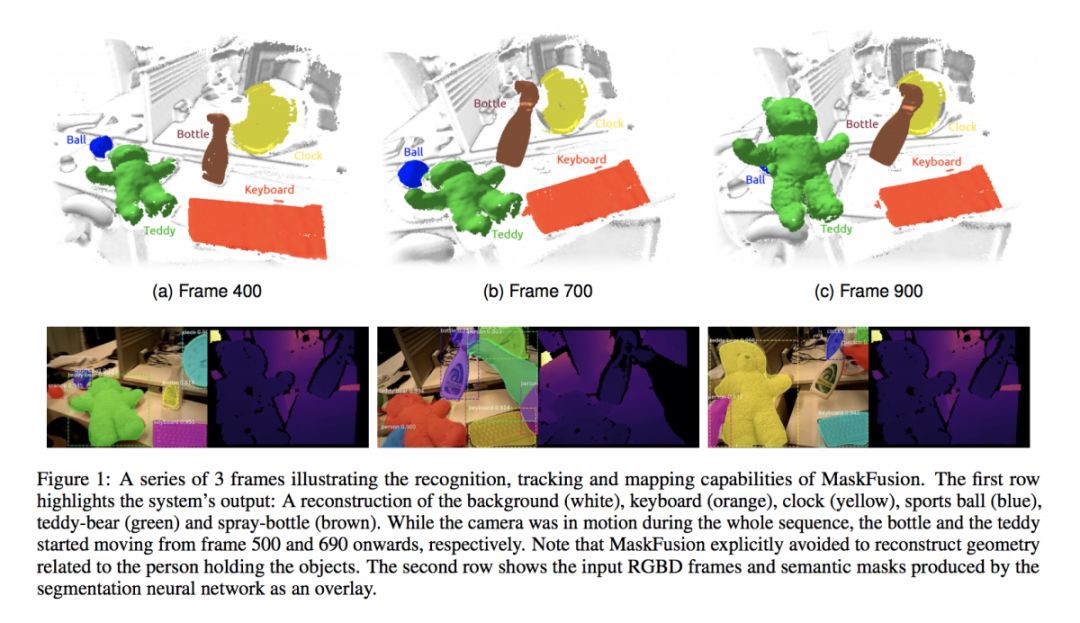

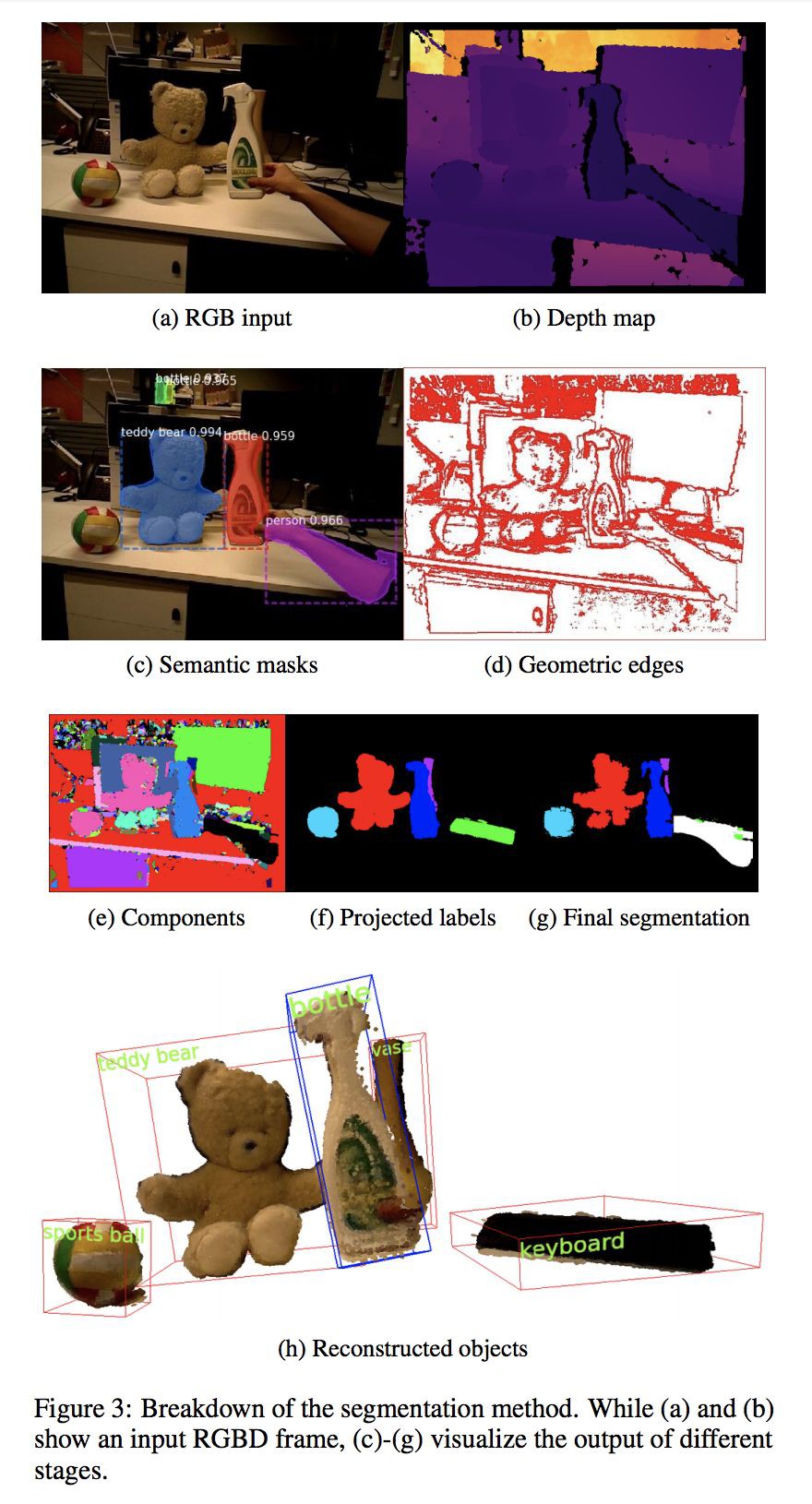

#Object Tracking

本文來自 UCL,論文提出了一種動態 RGBD SLAM 方案,不僅能實現實時的場景感知 3D 重建,而且利用了 Mask RCNN 以及幾何分割對 2D 影象進行實體分割,同時對映到 3D,建立 3D 模型的語意分割。並且將要開放原始碼,對於語意 SLAM 研究有著一定幫助。

▲ 論文模型:點選檢視大圖

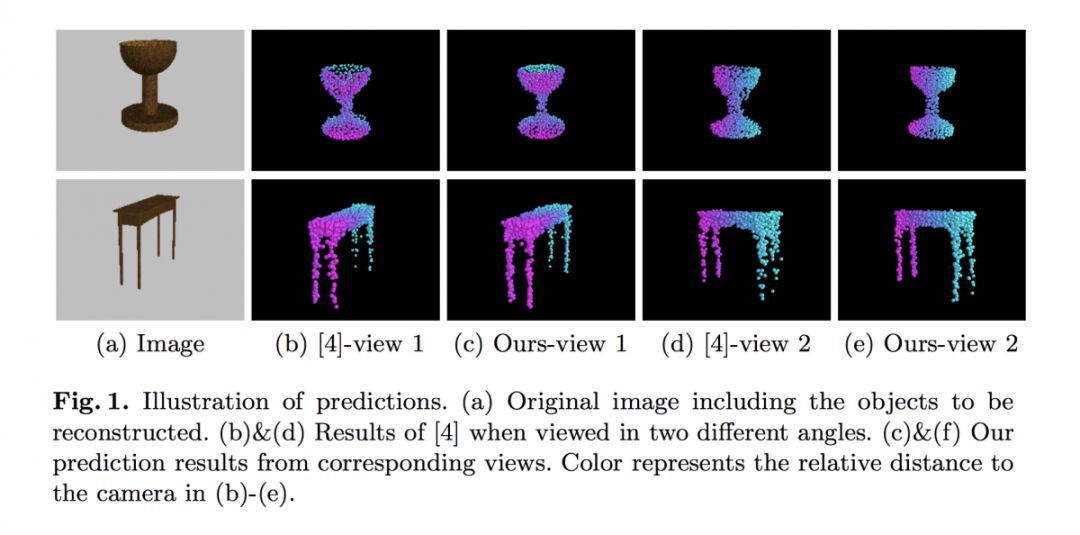

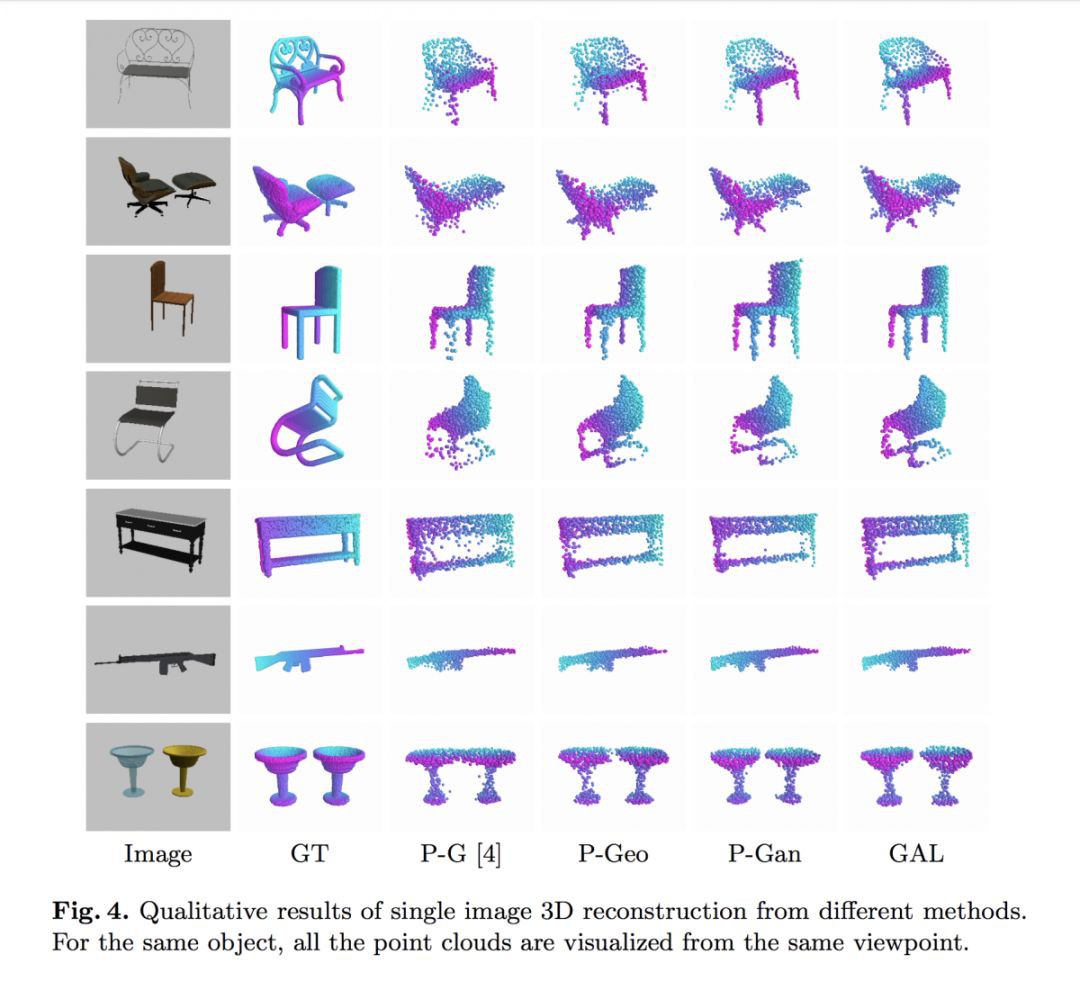

@woonchao 推薦

#3D Reconstruction

本文是香港中文大學和騰訊優圖聯合發表於 ECCV 2018 的工作,論文提出了一個用於基於點雲的 3D 模型重建損失函式,相較於傳統的 Chamfer distance,這個損失能更好的刻畫全域性資訊,對於提升 3D 模型重建效果有很大幫助。

論文用 GAL 來刻畫重建之後的模型損失,它由兩個術語組成,其中幾何損失確保從不同視點接近 Groundtruth 的重建 3D 模型的一致形狀,條件對抗性損失生成具有語意意義的點雲。

▲ 論文模型:點選檢視大圖

@paperweekly 推薦

#Image Retrieval

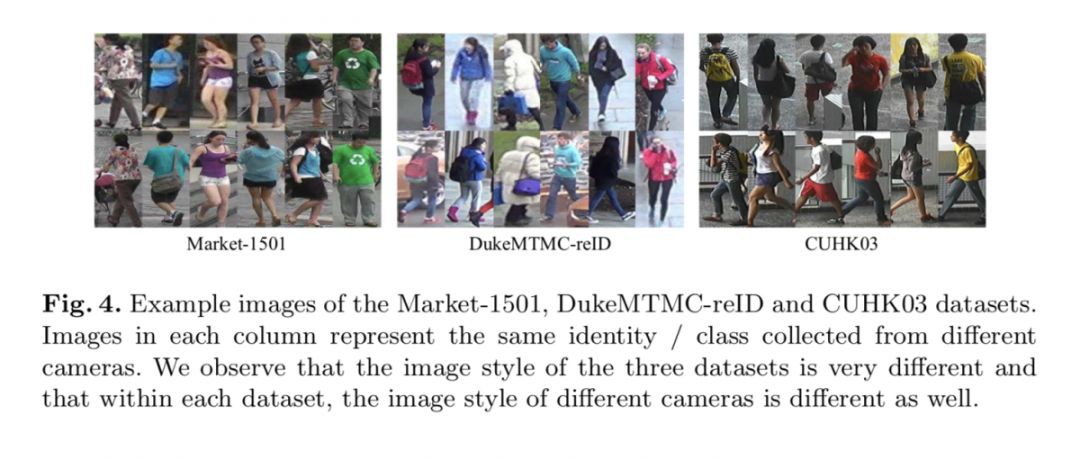

本文是廈門大學和悉尼科技大學發表於 ECCV 2018 的工作,論文提出了一種異質同源學習方法來解決無監督域適應問題,歸根結底其依然是基於 GAN 生成圖的工作。

本文工作主要基於兩個假設:1. 相機不變性,同未標註的正樣本對來學習到相機的風格;2. 域連通性,即 source 和 target 域的行人圖片預設沒有重疊,是負樣本對。第一點是同源學習,因為用的樣本都是相同域的。第二點是異質學習,因為用到了兩個域的樣本。

▲ 論文模型:點選檢視大圖

@xuehansheng 推薦

#Network Embedding

本文是香港科技大學和騰訊發表於 IJCAI 2018的工作,論文提出了一種可擴充套件的多路復用網路嵌入模型(scalable multiplex network embedding model),將多字形關係的資訊表示為一個統一的嵌入空間。

為了在保持其獨特屬性的同時組合不同型別關係的資訊,對於每個節點,作者為每種型別的關係提出一個高維公共嵌入和低維附加嵌入。然後,可以基於統一的網路嵌入模型聯合學習多個關係。

▲ 論文模型:點選檢視大圖

@simonhua 推薦

#Neural Networks

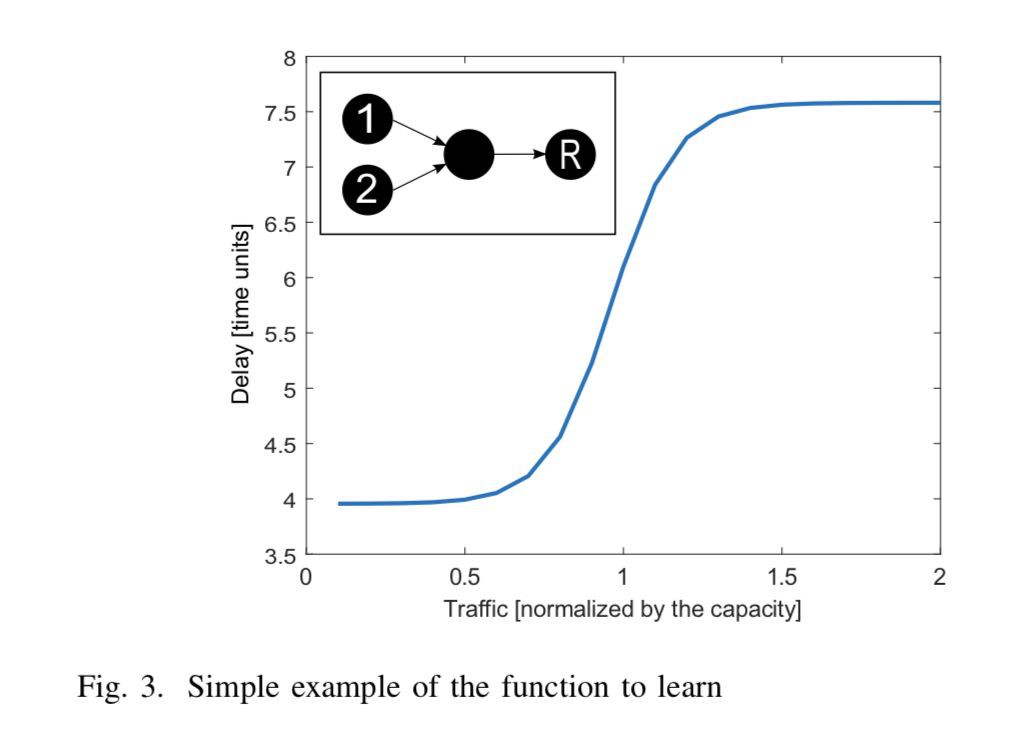

本文利用 ML 對網路進行建模用來評估網路效能,成功對網路建模有利於網路最佳化,配合 SDN 在 SDN 控制器的幫助下能夠有效對網路配置進行合理最佳化。本文提出了使用神經網路根據輸入流量函式準確對網路時延進行建模。

作者基於不同計算機網路引數(網路拓撲,網路大小,流量強度,路由策略)訓練了不同神經網路模型,研究了不同的計算機網路引數對於學習能力有何影響,對未來使用機器學習對網路建模的可行性進行了驗證並提出了幾點討論建議,可以作為實際環境部署的指南方針。

▲ 論文模型:點選檢視大圖

@MADONG 推薦

#Deep Reinforcement Learning

本文來自 DeepMind,論文主要貢獻如下:

1. 關係推理中深度學習的加入:深度學習讓關係表達的物件得以加入到我們的控制中,原先無法直接處理的物理物件可以引入了,這樣 agent 與真實世界的互動變得可能了,推理也就變得有意義了。 深度學習對特徵的提取功能,讓關係強化學習能夠關註在深度學習抽象後的特徵中,把特徵對應成自己需要掌握的關係物件。這樣其實比直接對應真實的物體更進一步;

2. Attention 模組的加入:Attention 模組讓關係強化學習中關係的表達得以更優秀。原本的 RNN 等演演算法對於序列的長短比較敏感,但是在 attention 機制下,兩個向量之間關係的計算不再受向量之間距離的影響。同一個場景下歐式距離較遠的物件也可以很好的提取出存在的關係;

3. 強化學習的加入:在這裡主要是監督 attention 模組中權值 w 的改變調整。

▲ 論文模型:點選檢視大圖

@xuehansheng 推薦

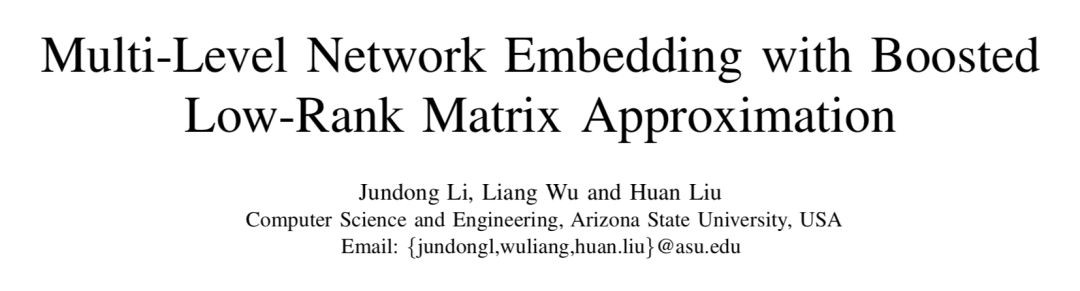

#Network Embedding

本文來自亞利桑那州立大學,論文提出了一種新穎的多級網路嵌入框架 BoostNE,它可以學習從粗到細的不同粒度的多個網路嵌入表示,而不會強加普遍的全域性低秩假設。方法新穎值得深入研究。

▲ 論文模型:點選檢視大圖

@linxi2333 推薦

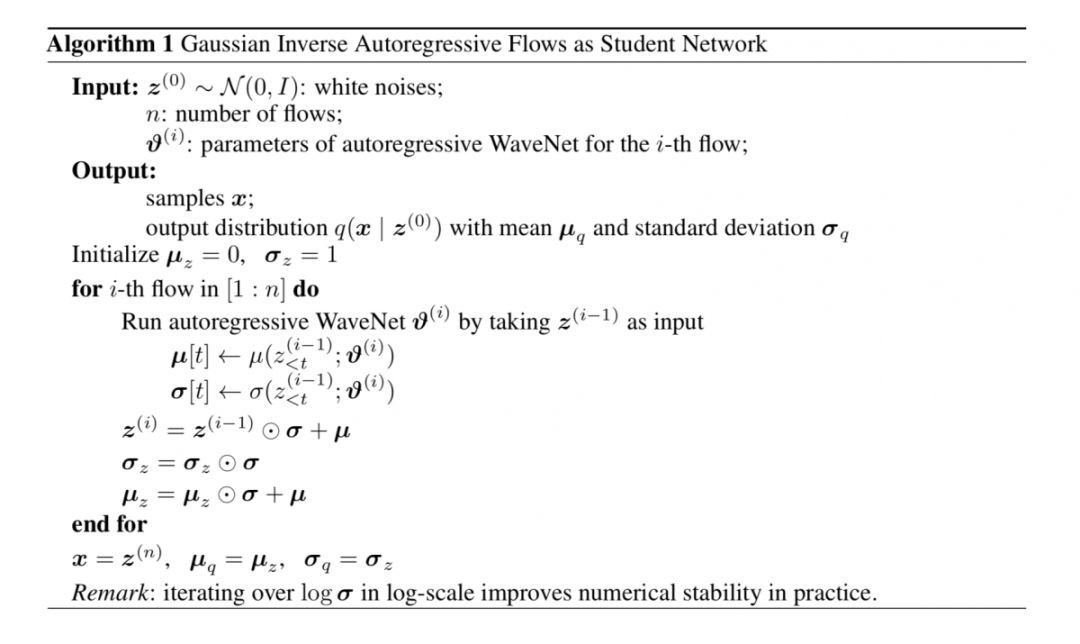

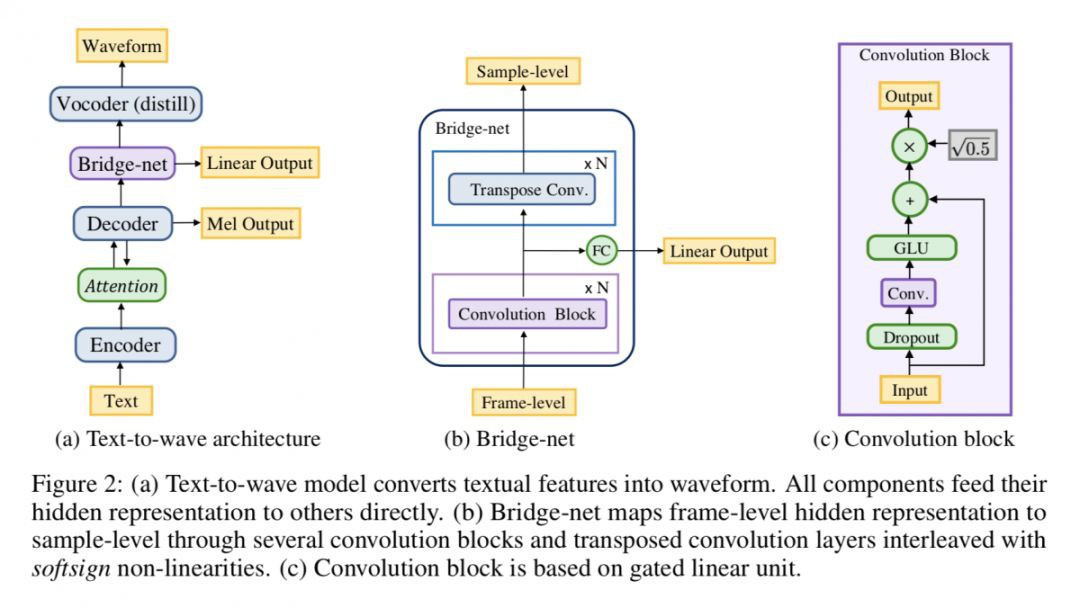

#Audio Generation

本文是對 DeepMind 的 Tacotron2 的改進,Tacotron2 是一種端到端的語音合成系統。論文單高斯簡化了 parallel WaveNet 的 KL 標的函式,改進了蒸餾演演算法(distillation),使得結構更簡單,更穩定;透過 Bridge-net 連線了 Tacotron(特徵預測網路)和 WaveNet,徹底實現端到端。

▲ 論文模型:點選檢視大圖

@Ttssxuan 推薦

#Reinforcement Learning

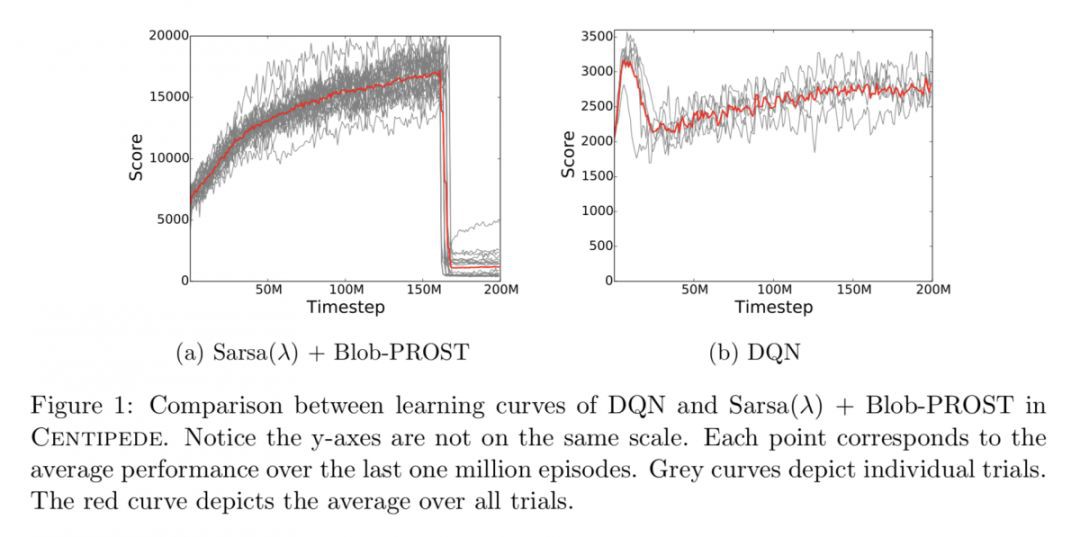

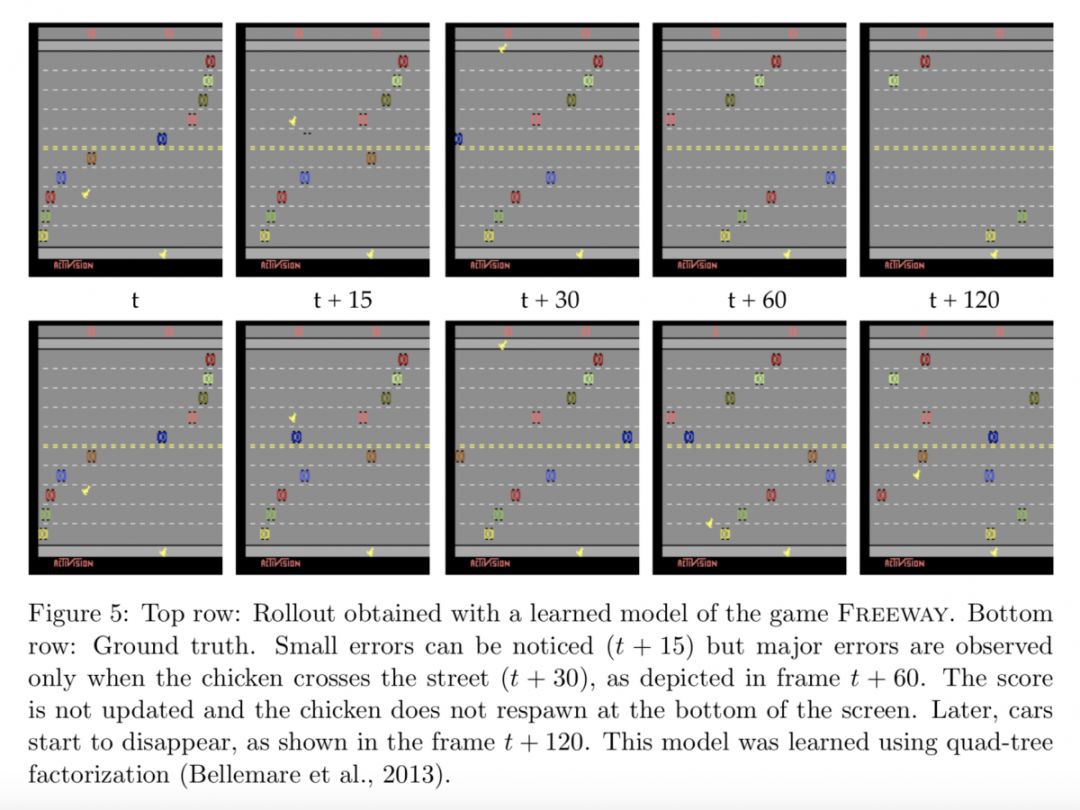

本文對 ALE (Arcade Learning Environment) 平臺做了進一步深入介紹,主要從以下幾點出發:1. 總結了關於 ALE 相關問題的經驗,如:Frame skipping, Color averaging and frame pooling 等;2. 總結最新成果,以及當前待解決的一些問題 ;3. 新的 ALE 版本,介紹了新平臺的特性,如:sticky actions, multiple game modes 等。

▲ 論文模型:點選檢視大圖

#推 薦 有 禮#

#推 薦 有 禮#

本期所有入選論文的推薦人

均將獲得PaperWeekly紀念周邊一份

▲ 深度學習主題行李牌/卡套 + 防水貼紙

禮物領取方式

推薦人請根據論文詳情頁底部留言

新增小助手領取禮物

想要贏取以上週邊好禮?

點選閱讀原文即刻推薦論文吧!

點選以下標題檢視往期推薦:

#投 稿 通 道#

#投 稿 通 道#

讓你的論文被更多人看到

如何才能讓更多的優質內容以更短路徑到達讀者群體,縮短讀者尋找優質內容的成本呢? 答案就是:你不認識的人。

總有一些你不認識的人,知道你想知道的東西。PaperWeekly 或許可以成為一座橋梁,促使不同背景、不同方向的學者和學術靈感相互碰撞,迸發出更多的可能性。

PaperWeekly 鼓勵高校實驗室或個人,在我們的平臺上分享各類優質內容,可以是最新論文解讀,也可以是學習心得或技術乾貨。我們的目的只有一個,讓知識真正流動起來。

? 來稿標準:

• 稿件確系個人原創作品,來稿需註明作者個人資訊(姓名+學校/工作單位+學歷/職位+研究方向)

• 如果文章並非首發,請在投稿時提醒並附上所有已釋出連結

• PaperWeekly 預設每篇文章都是首發,均會新增“原創”標誌

? 投稿郵箱:

• 投稿郵箱:hr@paperweekly.site

• 所有文章配圖,請單獨在附件中傳送

• 請留下即時聯絡方式(微信或手機),以便我們在編輯釋出時和作者溝通

?

現在,在「知乎」也能找到我們了

進入知乎首頁搜尋「PaperWeekly」

點選「關註」訂閱我們的專欄吧

關於PaperWeekly

PaperWeekly 是一個推薦、解讀、討論、報道人工智慧前沿論文成果的學術平臺。如果你研究或從事 AI 領域,歡迎在公眾號後臺點選「交流群」,小助手將把你帶入 PaperWeekly 的交流群裡。

▽ 點選 | 閱讀原文 | 獲取更多論文推薦

知識星球

知識星球